Přenesení AI na Edge zařízení pomocí Microsoft Translator

V listopadu 2016 společnost Microsoft přinesla výhody strojového překladu, který byl napájen z AI, a také jako NMT (nervový stroj Translation), vývojářům a koncovým uživatelům. Minulý týden Společnost Microsoft přinesla možnosti NMT k okraji mraku. využitím NPU, který je integrován do Palubní důstojník 10, Poslední telefonát od Huawei. Díky novému čipu jsou na přístroji k dispozici překlady založené na AI, a to i při absenci přístupu k Internetu, což umožňuje systému produkovat překlady, jejichž kvalita je v systému on-line.

K dosažení tohoto průlomu výzkumníci a inženýři ze společnosti Microsoft a Huawei spolupracovali na přizpůsobení nervového překladu do tohoto nového výpočetního prostředí.

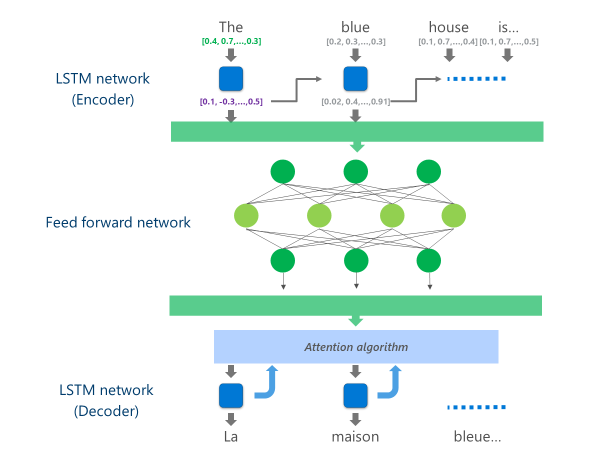

Nejpokročilejší NMT systémy, které jsou v současnosti ve výrobě (tj. používané v měřítku v oblaku firem a aplikací) používají architekturu neuronové sítě kombinující více vrstev Sítě LSTM, algoritmus upozornění a vrstvu překladu (dekodéru).

Animace níže vysvětluje zjednodušeným způsobem způsob fungování této vícevrstvé neuronové sítě. Další informace naleznete v "Co je stránka s překladem počítače"na serveru Microsoft Translator.

V rámci implementace NMT tyto střední vrstvy LSTM spotřebovávají velkou část výpočetního výkonu. Aby bylo možné spustit plný NMT na mobilním zařízení, bylo nutné najít mechanismus, který by mohl snížit tyto výpočetní náklady a zároveň co nejvíce zachovat kvalitu překladu.

V tomto případě přichází do hry jednotka NPU (nervový procesor Huawei). Výzkumní pracovníci a inženýři společnosti Microsoft využili výhod NPU, který je speciálně navržen pro aplikaci Excel při výpočetním AI s nízkou latencí, pro operace snižování zátěže, které by byly nepřijatelně pomalé pro zpracování na hlavním procesoru.

Provádění

Implementace, která je nyní k dispozici v aplikaci Microsoft Translator pro společnost Huawei Mate 10, optimalizuje překlady tím, že načítá nejvíce náročné úlohy na NPU.

Konkrétně tato implementace nahrazuje tyto střední síťové vrstvy LSTM hlubokým fnervová síť s předdopřednou sítí. Hluboké neuronové sítě pro předávání kanálů jsou výkonné, ale vyžadují velmi velké množství výpočtů z důvodu vysokého konektivity mezi neurony.

Neuronové sítě spoléhají především na multiplikace matrice, což je operace, která není složitá z matematického hlediska, ale velmi nákladná, když se provádí v měřítku, které je potřebné pro takovou hlubokou neurální síť. Huawei npu exceluje při provádění těchto maticových multiplikací v masivně paralelním módu. Je také poměrně efektivní z hlediska využití energie, což je důležitá kvalita zařízení poháněných bateriemi.

V každé vrstvě této sítě pro předávání těchto kanálů počítá NPU jak výstup RAW neuron, tak i následující Aktivační funkce ReLu efektivně a s velmi nízkou latencí. Využitím bohaté vysokorychlostní paměti na NPU provádí tyto výpočty souběžně, aniž by musel platit náklady na přenos dat (tj. zpomalení výkonu) mezi procesorem a NPU.

Jakmile je vypočítána konečná vrstva této hluboké sítě pro předávání kanálů, systém má bohatou reprezentaci slova zdrojového jazyka. Tato reprezentace je poté krmena "dekodérem zleva doprava", který vytvoří každé cílové jazykové slovo se stejným algoritmem pro upozornění používaným v online verzi NMT.

Jako Antonín Aue, vysvětluje hlavní technik vývoje softwaru v týmu Microsoft Translator: "nastavení systému spuštěného na výkonných serverech Cloud v datovém středisku a jeho spuštění beze změny na mobilním telefonu není realizovatelné. Mobilní zařízení mají omezení výpočetního výkonu, paměti a spotřeby energie, která nejsou k řešení shluku uplatněna. Přístup k NPU spolu s některými dalšími architektonickými náběhy nám umožnil obejít mnohá z těchto omezení a navrhnout systém, který může rychle a efektivně pracovat na zařízení, aniž by musel ohrozit kvalitu překladu.."

Implementace těchto překladatelských modelů pro inovativní čipovou sadu NPU umožňovala společnosti Microsoft a Huawei dodávat na zařízení neurální překlady v kvalitě srovnatelné se systémy založenými na oblakech, i když jste mimo síť.