Copilot اینجاست تا کمک کند

Copilot اینجاست تا کمک کند

درباره کارهایی که همراه شما می تواند انجام دهد بیشتر بدانید

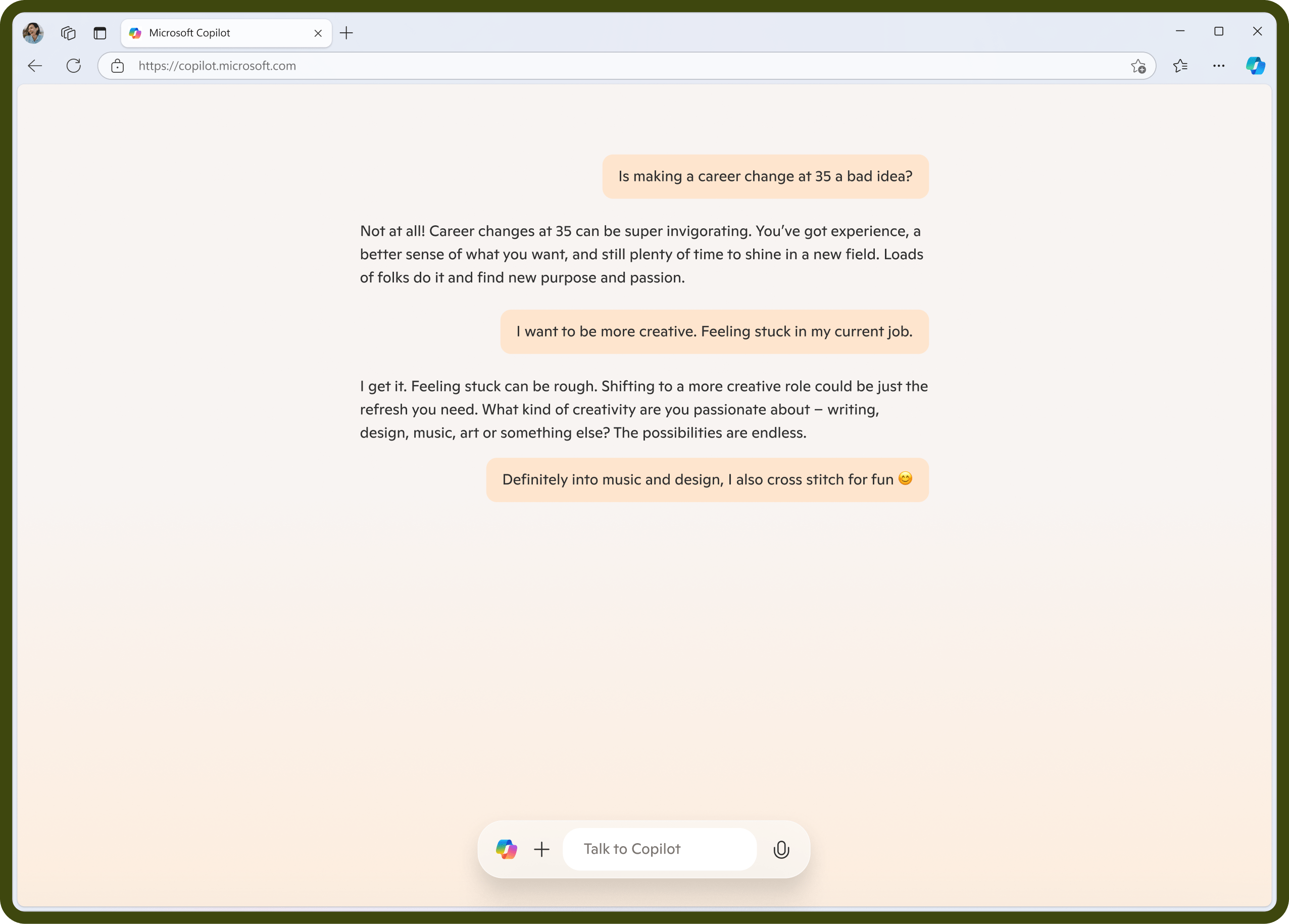

همراه برای هر چالشی

همراه برای هر چالشی

Copilot آماده ارائه مشاوره، بازخورد یا یادآوری مفید است تا شما را در مسیر خود نگه دارد، زیرا چالش های بزرگ و کوچک را بر عهده می گیرید.

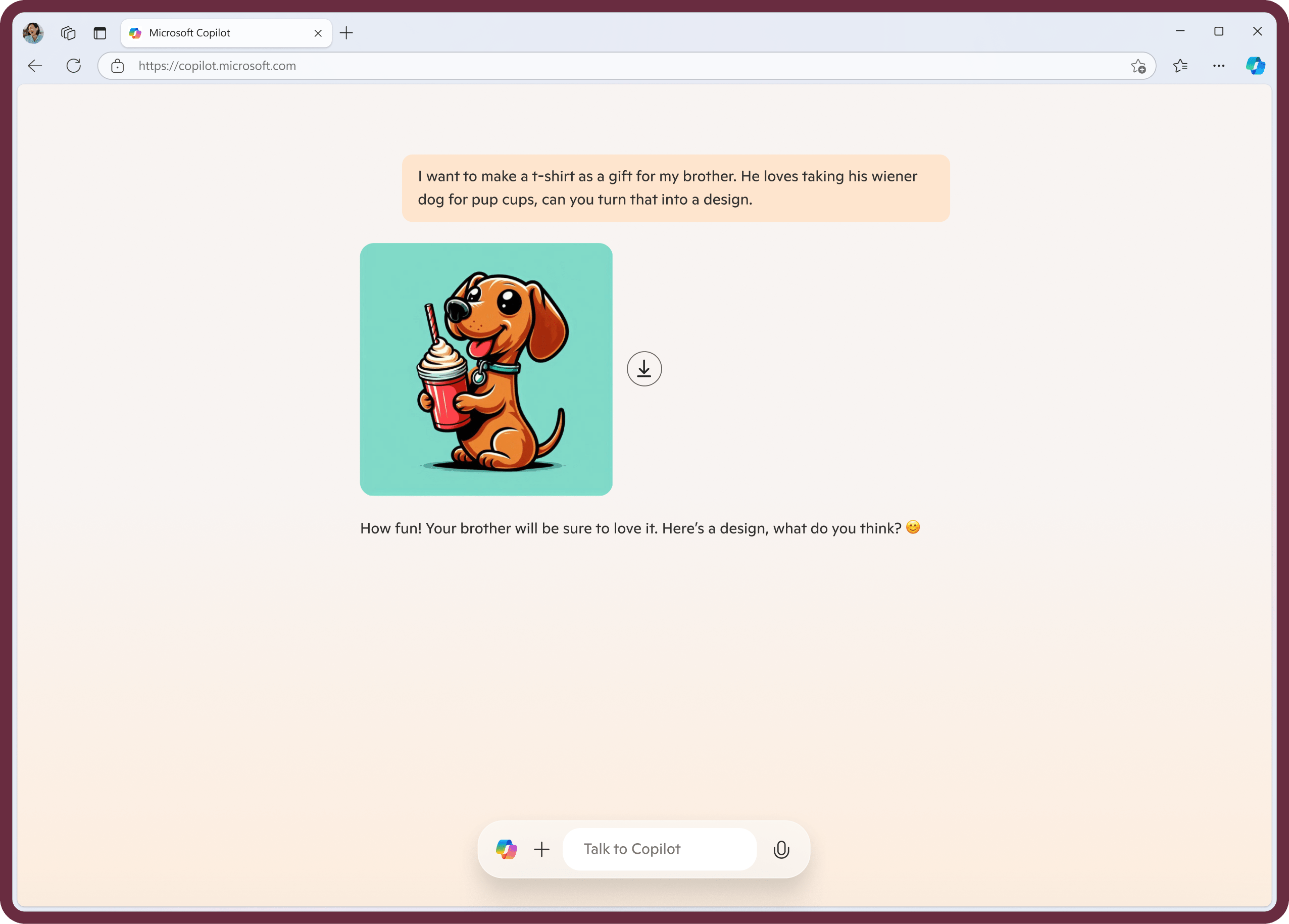

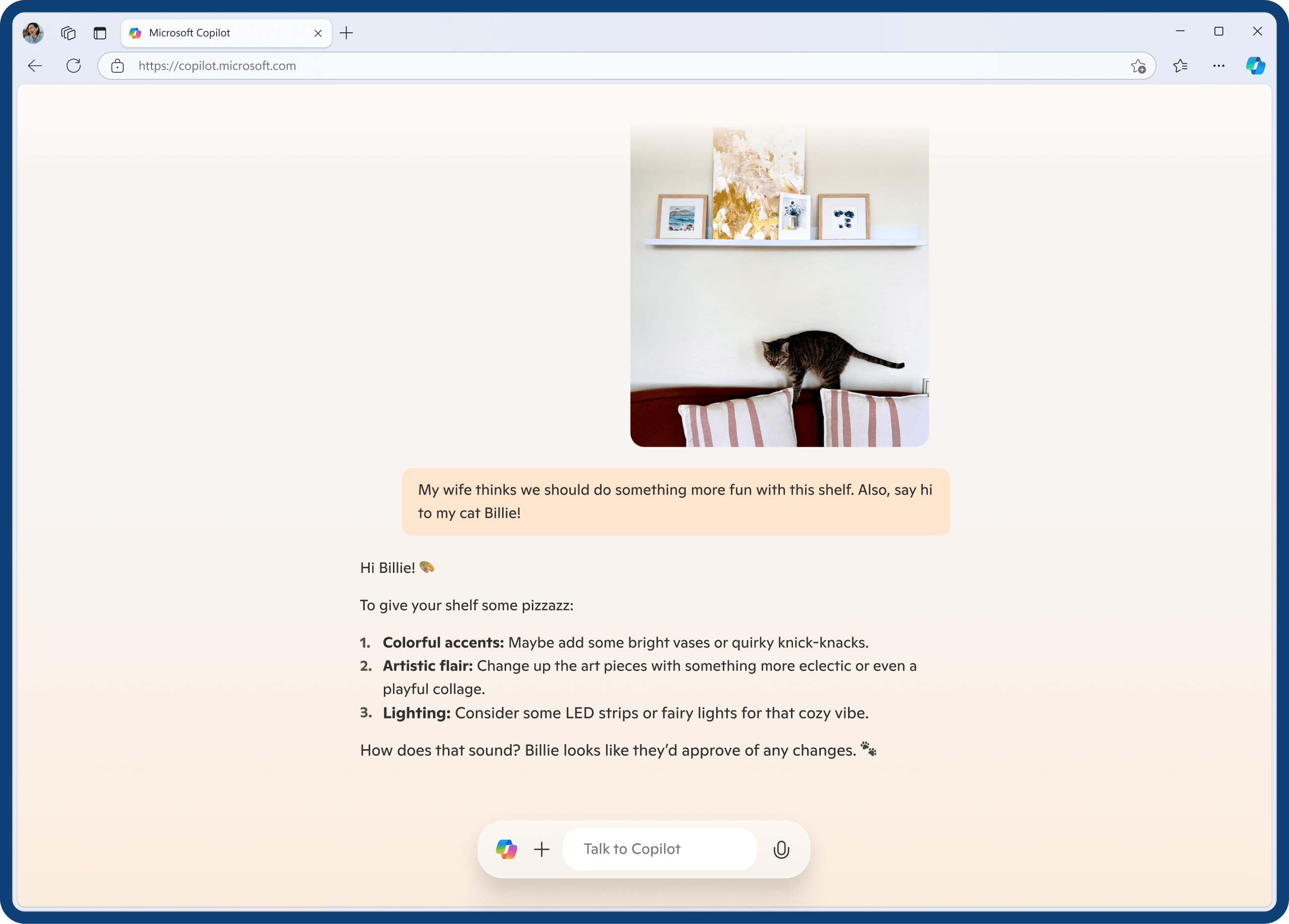

تصاویر، نوشتن و موارد دیگر - Copilot می تواند کمک کند

تصاویر، نوشتن و موارد دیگر - Copilot می تواند کمک کند

ایده های بزرگ خود را به تصاویر واقعی تبدیل کنید، فرآیند تحقیق خود را ساده کنید و نوشته خود را اصلاح کنید تا صدای شما بدرخشد.

پاسخ های ساده دریافت کنید

پاسخ های ساده دریافت کنید

Copilot به سوالات شما پاسخ می دهد و شما را از طریق چیزهای سخت راهنمایی می کند و درک چیزها را آسان می کند. مهم نیست که کنجکاوی شما به کجا منجر می شود، Copilot درست آنجاست - برای راهنمایی، شفاف سازی، ساده سازی و پشتیبانی.

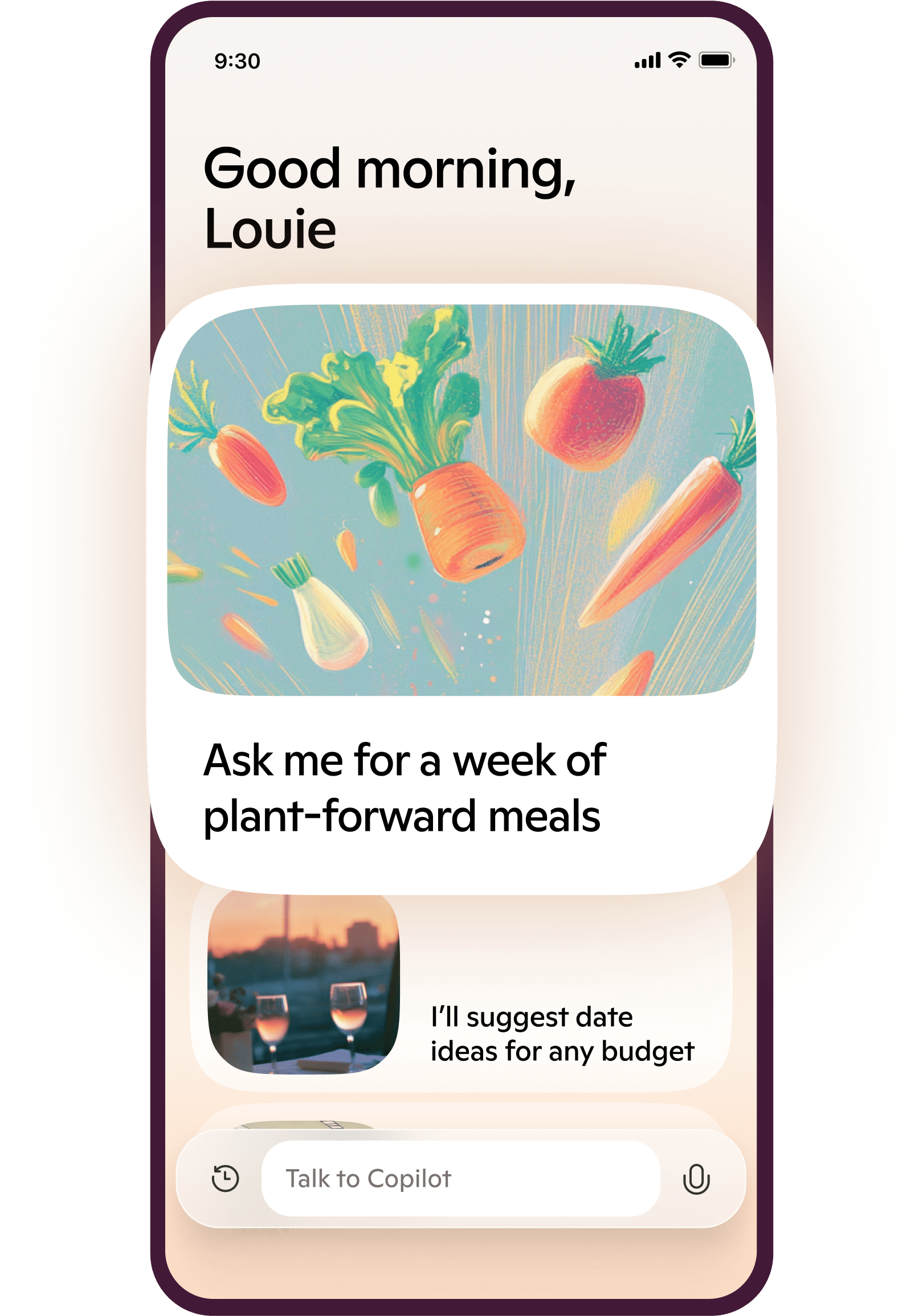

برنامه تلفن همراه Copilot به روز شده را تجربه کنید

برنامه تلفن همراه Copilot به روز شده را تجربه کنید

با طراحی تازه و قابلیت اطمینان پیشرفته، بصری تر از همیشه است. Copilot اکنون شما را در هر تعاملی به آرامی راهنمایی می کند. و هنگامی که برای کاوش بیشتر آماده هستید، نقل قول ها تأیید و گسترش جزئیات را آسان می کند. حتی می توانید از صدای خود برای صحبت کردن استفاده کنید و مکالمات و تنظیمات برگزیده شما در همه دستگاه هایتان همگام سازی می شود.

آرام. نفس. کمک خلبان

آرام. نفس. کمک خلبان

هر روز سؤالات جدیدی را به همراه دارد - چالش های بزرگ و کوچک. همه ما می توانیم از کمی کمک استفاده کنیم. یک تلنگر برای شروع، یا یک شریک قابل اعتماد برای رساندن شما به خط پایان. مهم نیست که چه لحظه، با Copilot، شما یک همراه دارید که برای کمک به شما اینجاست.

سوالات اغلب پرسیده شده

بیشترین بهره را از Copilot ببرید

بیشترین بهره را از Copilot ببرید

Microsoft Copilot یک دستیار دیجیتال مبتنی بر هوش مصنوعی است که برای شرکت در مکالمات و کمک به افراد در انجام طیف وسیعی از وظایف و فعالیت ها در دستگاه هایشان طراحی شده است. Copilot می تواند به سؤالات پاسخ دهد، تصاویر یا پیش نویس های محتوای نوشتاری ایجاد کند، راه های مختلفی را برای کلمات چیزهایی که نوشته اید پیشنهاد دهد و موارد دیگر.

ما Copilot را به روز کرده ایم تا بازخورد مشتریان خود را منعکس کند. این Copilot جدید یک تجربه سریعتر و ساده تر با ویژگی های جدید است که شخصی سازی را در اولویت قرار می دهد و به عنوان یک همراه هوش مصنوعی قابل اعتماد عمل می کند.

Copilot Pro همان به روزرسانی های Copilot را دریافت خواهد کرد که مزایای بیشتری برای مشترکین دارد. مشتریان می توانند تغییرات بصری یکسانی را ببینند، از Copilot Voice بیشتر استفاده کنند، از طریق آزمایشگاه های Copilot به ویژگی های جدید هوش مصنوعی دسترسی زودهنگام داشته باشند و در زمان های اوج مصرف دسترسی اولویت دار را تجربه کنند. مشترکین Copilot Pro همچنین به Copilot در برنامه های منتخب مایکروسافت 365 دسترسی دارند.

Copilot مانند داشتن یک دستیار پژوهشی، برنامه ریز شخصی و شریک خلاق در کنار شماست. با Copilot می توانید:

- یک سوال بپرسید، یک کنجکاوی را کشف کنید یا یک مکالمه را تمرین کنید. هنگامی که سؤالات پیچیده ای می پرسید، Copilot پاسخ های مفصلی به شما می دهد. با خیال راحت می توانید پیگیری هایی را بپرسید، مانند "آیا می توانید آن را ساده تر توضیح دهید؟" یا "لطفا گزینه های بیشتری به من بدهید".

- یک پاسخ واقعی دریافت کنید. Copilot به نتایج جستجو در سراسر وب نگاه می کند تا پاسخ خلاصه ای به شما ارائه دهد و به منابع آن پیوند دهد.

- خلاق باشید. هنگامی که به الهام نیاز دارید، Copilot می تواند به شما کمک کند شعر، داستان بنویسید یا حتی یک تصویر کاملا جدید ایجاد کنید. Copilot زمانی بهترین عملکرد را دارد که توصیفی تر باشید، بنابراین خلاق باشید و جزئیاتی مانند صفت، مکان یا حتی سبک های هنری مانند «هنر دیجیتال» و «فوتورئالیستی» را اضافه کنید.

هر مکالمه با Copilot تعداد محدودی تعامل خواهد داشت تا مکالمه جالب، مرتبط و مبتنی بر جستجو باشد.

صحبت کردن با Copilot باید طبیعی باشد. متن را تایپ کنید یا با صدای خود صحبت کنید - هر چیزی که برای مکالمه بهتر است. Copilot به طور خودکار زبانی را که استفاده می کنید تشخیص می دهد و بر اساس آن پاسخ می دهد. می توانید از Copilot بخواهید که به زبان دیگری نیز صحبت کند، اما برای انگلیسی بهینه شده است.

همانطور که در حال تعامل هستید، Copilot می تواند:

- وب را به گونه ای جستجو کنید که برای نحوه صحبت کردن، پیامک یا تفکر طبیعی به نظر برسد. یک پاسخ واحد و خلاصه شده با مجموعه ای از پیوندها یا یک پاسخ دقیق و منابع برای سؤالات پیچیده تر دریافت کنید.

- سوالات بعدی را برای سوال اولیه خود بپرسید یا برای دریافت پاسخ های مفیدتر جستجو کنید.

- پاسخ را دوباره بیان کنید و درک چیزها را آسان تر کنید. فقط چیزی شبیه به این بگویید، "می توانید آن را ساده تر توضیح دهید؟"

- وقتی درخواست می کنید با فرمت های مختلف مانند جدول یا لیست شماره گذاری شده پاسخ دهید.

- به شما کمک می کند شعر، داستان، سخنرانی بنویسید یا ایده هایی را برای یک پروژه به اشتراک بگذارید.

هنگامی که Copilot را از طریق صدا درگیر می کنید، Microsoft داده های صوتی را مطابق با خط مشی نگهداری داده های ما ذخیره می کند. Microsoft از مکالمات صوتی و سایر تعاملات با Copilot برای ارائه و بهبود سرویس همانطور که در اعلامیه حریم خصوصی Microsoft مشخص شده است استفاده می کند. همانطور که در ماه آگوست اعلام شد، ما همچنین از قبل به مشتریان خود اطلاع می دهیم که مدل های هوش مصنوعی مولد خود را در Copilot بر روی این داده ها آموزش می دهیم و راهی واضح و آسان برای انصراف از چنین آموزش هایی ارائه می دهیم. ما این را به تدریج اجرا می کنیم تا اطمینان حاصل کنیم که از قوانین حریم خصوصی در سراسر جهان پیروی می کنیم و در حال حاضر در مورد داده های مصرف کننده از بریتانیا، منطقه اقتصادی اروپا (EEA) و برخی از کشورهای دیگر آموزش نمی دهیم.

می توانید با کلیک بر روی نماد Copilot در بالا سمت راست به Microsoft Copilot در https://copilot.microsoft.com/، Microsoft Copilot Android و iOS، Copilot در برنامه Windows یا از طریق Edge دسترسی داشته باشید. برای یادگیری نکاتی برای استفاده از Copilot در Edge و سایر ویژگی های هوش مصنوعی در مرورگر، به صفحه نکات هوش مصنوعی مراجعه کنید.

جستجوی بصری به شما امکان می دهد تصاویر را در Copilot آپلود کنید و در مورد آنها سؤال بپرسید. به عنوان مثال، می توانید در مورد تصاویری که توصیف آنها دشوار است سؤال بپرسید، دستور پخت غذایی را که نام آن را نمی دانید تهیه کنید، نژاد سگی را که نمی شناسید شناسایی کنید و موارد دیگر. برای استفاده از جستجوی بصری، روی نماد دوربین در نوار ورودی در Copilot کلیک کنید، تصویری را از دستگاه خود آپلود کنید یا پیوند وب سایت ارائه دهید و از آن بپرسید.

برای کسب اطلاعات بیشتر در مورد Copilot Pro، به صفحه Copilot Pro مراجعه کنید.

در مورد هوش مصنوعی مسئول به من بگویید

در مورد هوش مصنوعی مسئول به من بگویید

Copilot محتوای مرتبط را در سراسر وب جستجو می کند و سپس اطلاعاتی را که پیدا می کند خلاصه می کند تا پاسخی مفید ایجاد کند. همچنین به منابع خود استناد می کند، بنابراین می توانید پیوندهایی به محتوایی که به آن ارجاع می دهد مشاهده کنید.

در مایکروسافت، ما تعهد خود به هوش مصنوعی مسئولانه را جدی می گیریم. Copilot مطابق با اصول هوش مصنوعی ما توسعه یافته است. ما با شریک خود OpenAI کار می کنیم تا تجربه ای را ارائه دهیم که استفاده مسئولانه و کار مدل اساسی را تشویق می کند. ما تجربه کاربری Copilot را برای نگه داشتن انسان ها در مرکز طراحی کرده ایم و یک سیستم ایمنی طراحی کرده ایم که برای کاهش خرابی ها و جلوگیری از سوء استفاده با مواردی مانند فیلتر محتوا، نظارت عملیاتی، تشخیص سوء استفاده و سایر اقدامات حفاظتی طراحی شده است. هوش مصنوعی مسئولانه یک سفر است و ما به طور مداوم در حال بهبود سیستم های خود در این راه هستیم. برای کسب اطلاعات بیشتر در مورد نحوه استفاده مسئولانه از Copilot، لطفا شرایط استفاده و منشور اخلاقی ما را مرور کنید.

در حالی که Copilot برای جلوگیری از اشتراک گذاری محتوای توهین آمیز غیرمنتظره در نتایج جستجو تلاش می کند و اقداماتی را برای جلوگیری از درگیر شدن ویژگی های Copilot با موضوعات بالقوه مضر انجام داده است، ممکن است همچنان نتایج غیرمنتظره ای مشاهده کنید. ما دائما در تلاش هستیم تا فناوری خود را برای جلوگیری از محتوای مضر بهبود بخشیم.

اگر با محتوای مضر یا نامناسب مواجه شدید، لطفا با کلیک بر روی دکمه «ارائه بازخورد» در تنظیمات یا استفاده از نماد پرچم زیر هر پاسخ در تلفن همراه و صفحه وب Copilot، بازخورد ارائه دهید یا نگرانی را به Copilot گزارش دهید. در برنامه Copilot، می توانید پاسخ را به مدت طولانی فشار دهید و «گزارش» را انتخاب کنید. ما به کار با بازخورد افراد ادامه خواهیم داد تا تجربه جستجوی ایمن را ارائه دهیم.

Copilot قصد دارد با منابع قابل اعتماد پاسخ دهد، اما هوش مصنوعی می تواند اشتباه کند و محتوای شخص ثالث در اینترنت ممکن است همیشه دقیق یا قابل اعتماد نباشد. Copilot ممکن است اطلاعاتی را که پیدا می کند نادرست جلوه دهد و ممکن است پاسخ هایی را ببینید که قانع کننده به نظر می رسند اما ناقص، نادرست یا نامناسب هستند. قبل از تصمیم گیری یا اقدام بر اساس پاسخ های Copilot، از قضاوت خود استفاده کنید و حقایق را دوباره بررسی کنید. بررسی استنادهای Copilot مکان خوبی برای شروع بررسی صحت است.

برای هم رسانی بازخورد سایت یا گزارش نگرانی، دکمه «بازخورد دادن» را در تنظیمات انتخاب کنید یا از نماد پرچم زیر هر پاسخ در تلفن همراه و صفحه وب Copilot استفاده کنید. در برنامه Copilot، می توانید پاسخ را به مدت طولانی فشار دهید و «گزارش» را انتخاب کنید. ما به کار با بازخورد افراد ادامه خواهیم داد تا تجربه جستجوی ایمن را برای همه فراهم کنیم.

درباره سابقه گفتگو بیشتر بدانید

درباره سابقه گفتگو بیشتر بدانید

بله، اگر وارد سیستم شده باشید، مکالماتی که با Copilot دارید ذخیره می شود. ما این را "تاریخچه چت" می نامیم. می توانید هر مکالمه ای را که قبلا با Copilot داشته اید مشاهده کرده و به آن دسترسی داشته باشید. به عنوان مثال، اگر از Copilot اطلاعاتی در مورد اولین فردی که روی ماه قدم می گذارد بخواهید، مکالمه ای که دارید در تاریخچه چت ذخیره می شود و هر زمان که بخواهید می توانید به آن بازگردید. به طور پیش فرض، داده های سابقه گپ را به مدت ۱۸ ماه از آخرین به روزرسانی مکالمه ذخیره می کنیم. می توانید با مراجعه به صفحه اصلی و انتخاب نماد ماشین زمان، به تاریخچه گفتگوهای خود دسترسی داشته باشید و آن را حذف کنید.

دو تنظیم در تنظیمات Copilot برای کنترل داده های Copilot وجود دارد:

- می توانید توانایی هوش مصنوعی را برای استفاده از داده های خود برای آموزش مدل ها خاموش کنید. برای انجام این کار، به ورود به سیستم > تنظیمات > حساب > آموزش حریم خصوصی >مدل بروید. همچنین می توانید به حریم خصوصی > صادرات/حذف بروید تا تاریخچه گفتگو را از account.microsoft.com حذف کنید. لطفا توجه داشته باشید، اگر در منطقه اقتصادی اروپا (EEA)، بریتانیا و برخی از کشورهای دیگر هستید، Copilot در حال حاضر از داده های شما برای آموزش مدل ها استفاده نمی کند.

- می توانید شخصی سازی را خاموش کنید. اگر از این تنظیم استفاده کنید، همچنان به تاریخچه چت دسترسی خواهید داشت و همه گفتگوهای آینده ذخیره می شوند، اما تجربیات Copilot شخصی سازی نمی شوند. اگر بخواهید تجربه را فعال کنید، Copilot همچنین از تاریخچه جستجوی Bing و ابراز علاقه MSN برای ایجاد مکالمات شخصی تر و روان تر استفاده می کند. برای کاربران در منطقه اقتصادی اروپا، بریتانیا، و تعداد محدودی از کشورهای دیگر، ما در حال ارزیابی گزینه ها قبل از ارائه این سطح از شخصی سازی برای آن کاربران هستیم. در صورت ارائه ، Copilot به کاربران اطلاع می دهد و راهی واضح و آسان برای انصراف از شخصی سازی در اختیار آنها قرار می دهد.

برای حذف تاریخچه گفتگوی Copilot، از تنظیمات به حساب > حریم خصوصی > صادرات یا حذف تاریخچه بروید تا تاریخچه خود را از داشبورد حریم خصوصی Microsoft خود حذف کنید. علاوه بر این، در داشبورد حریم خصوصی Microsoft خود روی «مرور و جستجو» کلیک کنید و به بخش تاریخچه جستجو بروید. در کادر جستجو، همه نمونه هایی را که شامل "Microsoft Copilot" هستند، جستجو و حذف کنید.

اگر می خواهید گفتگوها را از Copilot قبل از 10/01/2004 (تجربه قدیمی) حذف کنید، در داشبورد حریم خصوصی Microsoft خود روی «مرور و جستجو» کلیک کنید، به بخش تاریخچه فعالیت Copilot بروید و روی «پاک کردن همه تاریخچه فعالیت های Copilot و سابقه جستجو» کلیک کنید.

بله، ما برخی از تاریخچه گفتگوهای شما از جمله درخواست ها را برای ارائه و بهبود خدمات نگه می داریم. درخواست های شما مطابق با بیانیه حریم خصوصی ما نگهداری می شوند و برای نظارت بر عملکرد، عیب یابی مشکلات، تشخیص اشکالات، جلوگیری از سوء استفاده و سایر تجزیه و تحلیل عملکرد محصول لازم برای ارائه و بهبود Copilot استفاده می شوند. فقط داده های قابل مشاهده در تاریخچه چت در محصول برای پاسخ های شخصی استفاده می شود.

برای آشنایی بیشتر با شیوه های حفظ حریم خصوصی Microsoft، اعلامیه حریم خصوصی Microsoft و مرکز حریم خصوصی ما را مرور کنید.

تجربه Copilot خود را شخصی سازی کنید

تجربه Copilot خود را شخصی سازی کنید

اگر شخصی سازی را روشن کنید، از مکالمات اخیر شما و فعالیت های Microsoft برای شخصی سازی تجربه شما استفاده خواهیم کرد. فعالیت های Microsoft شما، بسته به تنظیمات حریم خصوصی شما، ممکن است شامل فعالیت های جستجوی Bing، فعالیت های MSN و علایق استنباط شده شما باشد. اگر نمی خواهید با استفاده از یک مکالمه خاص از تاریخچه گفتگو، سابقه جستجو یا علایق استنباط شده شما شخصی سازی کنیم، می توانید آنها را در داشبورد حریم خصوصی Microsoft حذف کنید. می توانید در هر زمان با کلیک کردن روی نماد حساب خود در گوشه سمت چپ >بالای صفحه حساب > حریم خصوصی > شخصی سازی، شخصی سازی را خاموش کنید. در Edge، می توانید با کلیک بر روی "...": از منوی تنظیمات Copilot > مجوزها و حریم خصوصی > شخصی سازی خاموش کنید.

اجازه دادن به شخصی سازی Copilot به این معنی است که به مایکروسافت اجازه می دهید از مکالمات اخیر شما و فعالیت های Microsoft از جمله جستجوی Bing و فعالیت های MSN استفاده کند تا Copilot را برای شما شخصی تر کند. Copilot تاریخچه شما را به خاطر می آورد و ممکن است از آن تاریخچه در مورد علایق، سرگرمی ها و غیره شما استنباط کند تا تجربیات شخصی را ارائه دهد. با این حال، به عنوان یک کاربر Copilot، می توانید تمام پیام های چت را حذف کنید.

نه. کلید شخصی سازی Copilot (در همه سطوح Copilot موجود است)، کنترل می کند که آیا مکالمات اخیر و فعالیت های Microsoft شما برای شخصی سازی استفاده می شود یا خیر. ضامن شخصی سازی و تبلیغات Edge کنترل می کند که آیا می توان از فعالیت های مرور Edge در سطوح Microsoft برای شخصی سازی از جمله Copilot استفاده کرد یا خیر.

شما کنترل می کنید که از کدام گفتگوها برای شخصی سازی تجربه تان استفاده شود. اگر نمی خواهید Copilot با استفاده از تاریخچه چت شما شخصی سازی کند، می توانید تاریخچه فعالیت Copilot را در داشبورد حریم خصوصی مایکروسافت پاک کنید. پس از حذف، گفتگوها برای شخصی سازی تجربیات استفاده نمی شوند.

شخصی سازی به طور پیش فرض روشن است، به جز آنهایی که در منطقه اقتصادی اروپا (EEA)، بریتانیا و برخی از کشورهای دیگر هستند. کاربران این امکان را دارند که از تجربه انصراف دهند. در مکالمات خود، به شما اطلاع داده می شود که آیا تجربیات شما شخصی است یا خیر. اگر تجربه شخصی مجاز باشد، اطلاعیه ای مانند "Copilot می تواند در مورد علایق شما بیاموزد و تجربه شما را شخصی سازی کند" نمایش خواهیم داد. اطلاعیه ای مانند "مکالمات برای آموزش هوش مصنوعی استفاده می شود و Copilot می تواند در مورد علایق شما بیاموزد." زمانی نمایش داده می شود که آموزش و شخصی سازی مجاز باشد. بسته به منطقه شما، شخصی سازی ممکن است به طور پیش فرض در دسترس باشد. شخصی سازی برای کاربران احراز هویت نشده در دسترس نیست.

ما شیوه های هوش مصنوعی مسئولانه خود را دنبال می کنیم و این ویژگی را به آرامی عرضه می کنیم. در نتیجه، ممکن است این ویژگی هنوز در منطقه اقتصادی اروپا (EEA)، بریتانیا و برخی از کشورهای دیگر در دسترس نباشد.

می توانید شخصی سازی را از طریق تنظیمات شخصی سازی در منوی تنظیمات Copilot خاموش کنید.

اگر رضایت شخصی سازی خود را از «بله» به «خیر» تغییر دهید، فقط ارائه تجربه شخصی سازی شده Copilot را متوقف خواهیم کرد. ما سابقه گفتگوهای شما را نگه می داریم تا همچنان بتوانید مکالمات گذشته خود را مشاهده کنید. با این حال، تجربه آینده Copilot شما دیگر شخصی نخواهد بود.

بله، می توانید شخصی سازی را در تنظیمات Copilot در هر زمان خاموش کنید. خاموش کردن شخصی سازی سابقه گفتگوهایتان را حذف نمی کند.

صرف نظر از تنظیمات کاربر شما، Copilot به گونه ای طراحی نشده است که تعاملات را بر اساس برخی موضوعات شخصی سازی کند تا از حریم خصوصی شما محافظت کند و از استفاده از اطلاعات بالقوه حساس جلوگیری کند. برای مثال، اقداماتی را انجام می دهیم تا زمینه را از مکالمه های گذشته شما حذف کنیم که ممکن است حساس تلقی شوند، حتی اگر سابقه گپ و شخصی سازی در تنظیماتتان روشن باشد. کاربران باید هنگام به اشتراک گذاشتن اطلاعاتی که از نظر آنها حساس است با Copilot احتیاط کنند.

بررسی گزینه های استفاده و کنترل داده ها

بررسی گزینه های استفاده و کنترل داده ها

هوش مصنوعی مولد به دسته ای از مدل های هوش مصنوعی اطلاق می شود که داده ها را تجزیه و تحلیل می کنند، الگوها را پیدا می کنند و از این الگوها برای تولید یا ایجاد یک خروجی جدید مانند متن، عکس، ویدیو، کد، داده و موارد دیگر استفاده می کنند. "آموزش" یک مدل هوش مصنوعی به معنای ارائه داده ها به آن برای کمک به یادگیری پیش بینی یا تصمیم گیری است. آموزش یک مفهوم گسترده است که شامل فعالیت های مختلفی برای کمک به مدل ها برای یادگیری پیش آموزش یک مدل هوش مصنوعی مولد، تنظیم دقیق یک مدل، یا آموزش طبقه بندی کننده یا فیلتر برای کمک به مدل ها در ارائه نتایج مناسب تر است.

این مدل ها از الگوها و همبستگی های آموخته شده از داده های آموزشی خود برای پیش بینی آنچه در آینده در یک دنباله اتفاق می افتد استفاده می کنند. آنها برای یادگیری روابط کلی در زبان تنظیم شده اند، نه برای به خاطر سپردن بخش های خاصی از داده های آموزشی. آنها داده های آموزشی اصلی را ذخیره نمی کنند یا به آنها دسترسی ندارند. در عوض، مدل های هوش مصنوعی مولد برای تولید آثار و محتوای بیانی جدید طراحی شده اند. ما همچنین اقدامات بیشتری را برای جلوگیری از بازتولید ناخواسته داده های آموزشی این مدل ها انجام می دهیم، مانند انجام آزمایش و ساخت فیلترهایی که مطالب منتشر شده یا استفاده شده قبلی را غربال می کنند.

مایکروسافت از داده های در دسترس عموم استفاده می کند که بیشتر از مجموعه داده های یادگیری ماشینی استاندارد صنعتی و خزیدن های وب، مانند موتورهای جستجو جمع آوری می شود. منابعی را که دیوارهای پرداخت دارند، محتوایی که خط مشی های ما را نقض می کند، یا سایت هایی که با استفاده از کنترل های وب منتشر شده از آموزش انصراف داده اند، مستثنی می کنیم. علاوه بر این، ما بر روی داده های دامنه های فهرست شده در فهرست بازارهای بدنام تقلب و دزدی دریایی دفتر نماینده تجاری ایالات متحده (USTR) آموزش نمی دهیم.

ما بر روی داده های مشتریان تجاری خود یا داده های کاربرانی که به حساب سازمانی M365/EntraID وارد شده اند، آموزش نمی دهیم. ما همچنین بر روی داده های اشتراک های شخصی یا خانوادگی M365 یا داده های کاربرانی که به حساب Microsoft خود وارد نشده اند آموزش نمی دهیم.

مایکروسافت اواخر امسال شروع به استفاده از داده های مصرف کننده برای آموزش هوش مصنوعی در برخی کشورها خواهد کرد. برای کاربرانی که به حساب مایکروسافت وارد شده اند، می توانید کنترل کنید که آیا از داده های مصرف کننده شما برای آموزش مدل های هوش مصنوعی مولد مورد استفاده در Copilot و سایر پیشنهادات هوش مصنوعی مایکروسافت از طریق کنترل انصراف استفاده می شود یا خیر. انصراف از داده های مصرف کننده گذشته، حال و آینده شما را از استفاده برای آموزش این مدل های هوش مصنوعی محروم می کند، مگر اینکه تصمیم بگیرید دوباره انتخاب کنید. این تنظیم در ماه های آینده در نسخه های وب، دسکتاپ و موبایل همه محصولات مصرفی درون محدوده در دسترس قرار خواهد گرفت. همچنین پیام های درون محصولی را مشاهده خواهید کرد که در مورد کنترل کاربر جدید، از جمله در Bing، MSN و Copilot به شما اطلاع می دهند.

ما داده هایی را که برای آموزش استفاده می کنیم محدود خواهیم کرد. ما بر روی داده های بخش دولتی یا مشتریان سازمانی خود آموزش نخواهیم دید، مگر اینکه آنها صراحتا انتخاب کنند، و همچنین بر روی هیچ داده ای از پیشنهادات مصرف کننده M365 آموزش نخواهیم دید. در اینجا بیشتر بدانید. ما همچنین مدل های هوش مصنوعی را بر روی داده های حساب شخصی مانند داده های نمایه حساب Microsoft یا محتوای ایمیل شما آموزش نمی دهیم. اگر تصویری در مکالمات هوش مصنوعی شما گنجانده شود، اقداماتی را برای غیرقابل شناسایی کردن آنها انجام می دهیم، مانند حذف ابرداده یا سایر داده های شخصی و محو کردن تصاویر چهره.

تعاملات شخصی شما با سرویس های ما مانند پرسش ها و پاسخ ها خصوصی نگه داشته می شود و بدون اجازه شما فاش نمی شود. می توانید شخصی سازی خود را در تنظیمات تنظیم کنید.

ما اطلاعاتی را که ممکن است شما را شناسایی کند، مانند نام، شماره تلفن، شناسه های دستگاه یا حساب، داده های شخصی حساس، آدرس های فیزیکی و آدرس های ایمیل، قبل از آموزش مدل های هوش مصنوعی، حذف می کنیم.

هنگام استفاده از سرویس های ما، داده های شما خصوصی باقی می مانند. ما به ارزیابی مدل های خود ادامه خواهیم داد و اقداماتی را برای جلوگیری از بازتولید اطلاعات کاربر یا مکالمات گذشته توسط مدل ها انجام خواهیم داد. ما از داده های شخصی شما همانطور که در اعلامیه حریم خصوصی Microsoft توضیح داده شده است و مطابق با قوانین حفظ حریم خصوصی در سراسر جهان محافظت خواهیم کرد.

ما از داده های کاربران زیر 18 سال استفاده نمی کنیم. ما فقط مدل های هوش مصنوعی مولد خود را بر روی داده های کاربران احراز هویت شده MSA 18 سال یا بالاتر آموزش می دهیم. علاوه بر این، اگر در منطقه اقتصادی اروپا (EEA)، بریتانیا و برخی از کشورهای دیگر فهرست شده در زیر هستید، در حال حاضر از داده های شما برای آموزش مدل های هوش مصنوعی استفاده نمی شود.

مایکروسافت اواخر امسال شروع به استفاده از داده های Bing، MSN، Copilot و تعاملات با تبلیغات در Microsoft برای آموزش هوش مصنوعی خواهد کرد. این شامل داده های جستجو و اخبار ناشناس، تعامل با تبلیغات، و داده های مکالمه صوتی و متنی با Copilot مانند درخواست ها، پرس و جوها، چت ها، پاسخ ها و موارد دیگر است. این داده ها برای بهبود Copilot و سایر مدل های هوش مصنوعی مولد ما برای ایجاد تجربه کاربری بهتر برای شما و دیگران استفاده می شود. این مدل های هوش مصنوعی مولد همچنین ممکن است برای بهبود سایر محصولات و خدمات مایکروسافت استفاده شوند. برای کاربرانی که به حساب مایکروسافت خود وارد شده اند، می توانید کنترل کنید که آیا داده های مصرف کننده شما برای آموزش مدل های هوش مصنوعی مولد مورد استفاده در Copilot و سایر پیشنهادات هوش مصنوعی مایکروسافت از طریق کنترل انصراف استفاده می شود یا خیر.

با استفاده از داده های مصرف کننده در دنیای واقعی برای کمک به آموزش مدل های هوش مصنوعی مولد زیربنایی خود، می توانیم Copilot را در آینده بهبود بخشیم و تجربه زبان طبیعی شخصی تر و مرتبط تری را ارائه دهیم. به عنوان مثال، مدل های هوش مصنوعی ما می توانند از این مکالمات برای یادگیری از الگوهای ارتباطی انسانی، مانند درک عبارات محاوره ای یا منابع محلی استفاده کنند. هرچه تنوع بیشتری در مکالمات مدل های هوش مصنوعی ما در معرض آن قرار بگیرند، زبان های مهم منطقه ای، جغرافیا، مراجع فرهنگی و موضوعات پرطرفدار مورد علاقه کاربران را بهتر درک می کنند و به آنها خدمت می کنند.

ما همچنین از مکالمات Copilot و سایر داده های مصرف کننده برای اهداف ایمنی، امنیت و انطباق دیجیتالی همانطور که در اعلامیه حریم خصوصی Microsoft ذکر شده است استفاده می کنیم.

قبل از شروع آموزش، ما همچنین این کار را برای افراد آسان می کنیم که در صورت تمایل، از استفاده از داده هایی که در این سرویس ها به اشتراک می گذارند برای آموزش مدل های هوش مصنوعی مولد ما استفاده کنند. ما کنترل های انصراف را از ماه اکتبر ارائه خواهیم کرد. برای اینکه به کاربران زمان کافی برای بررسی انتخاب خود بدهیم، ما همچنین آموزش مدل های هوش مصنوعی را بر روی این داده ها تا حداقل 15 روز پس از ارائه این کنترل های انصراف آغاز نخواهیم کرد. در حال حاضر، ما از داده های مصرف کننده برای آموزش مدل ها در منطقه اقتصادی اروپا (EEA)، بریتانیا و برخی از کشورهای دیگر که در زیر فهرست شده اند استفاده نخواهیم کرد. ما این را به تدریج در آن مناطق گسترش خواهیم داد تا اطمینان حاصل کنیم که این حق را برای مصرف کنندگان دریافت می کنیم و از قوانین حفظ حریم خصوصی محلی در سراسر جهان پیروی می کنیم.

این تنظیم انصراف از داده های شما برای سایر بهبودهای عمومی محصول یا سیستم یا استفاده برای تبلیغات، ایمنی دیجیتال، امنیت و اهداف انطباق همانطور که در اعلامیه حریم خصوصی Microsoft ذکر شده است، مستثنی نمی شود.

به مصرف کنندگانی که 18 سال یا بیشتر دارند و وارد حساب های مایکروسافت (مصرف کننده) خود شده اند، این امکان داده می شود که از ماه اکتبر از آموزش هوش مصنوعی انصراف دهند. این تنظیم در ماه سپتامبر در بازارهای زیر در دسترس نخواهد بود: اتریش، بلژیک، برزیل، بلغارستان، کانادا، چین (از جمله هنگ کنگ)، کرواسی، قبرس، جمهوری چک، دانمارک، استونی، فنلاند، فرانسه، آلمان، یونان، مجارستان، ایسلند، ایرلند، اسرائیل، ایتالیا، لتونی، لیختن اشتاین، لیتوانی، لوکزامبورگ، مالت، هلند، نروژ، نیجریه، لهستان، پرتغال، رومانی، اسلواکی، اسلوونی، کره جنوبی، اسپانیا، سوئد، سوئیس، انگلستان و ویتنام. این شامل مناطق گوادلوپ، گویان فرانسه، مارتینیک، مایوت، جزیره ریونیون، سنت مارتین، آزور، مادیرا و جزایر قناری است. این بدان معناست که پیشنهادات هوش مصنوعی در آن بازارها در دسترس خواهد بود، اما تا اطلاع ثانوی از هیچ داده کاربری برای آموزش مدل هوش مصنوعی مولد در آن مکان ها استفاده نخواهد شد.

نه، هیچ چیزی که به Copilot می گویید هرگز علنی نخواهد شد. Copilot در طول مکالمه با سایر کاربران به تاریخچه چت یا داده های شخصی شما دسترسی مستقیم نخواهد داشت.

این تغییر در مورد پیشنهادات مصرف کننده Copilot از جمله Copilot Pro اعمال می شود.

کاربران Copilot با حفاظت از داده های تجاری و هر کاربر مصرف کننده مایکروسافت 365 یا مکالمات Copilot یکپارچه در برنامه های مصرف کننده Microsoft 365 مانند Word، Excel، PowerPoint یا Outlook را مستثنی می کند. کاربران آن محصولات این تنظیمات را نخواهند دید و مکالمات آنها برای آموزش مدل های هوش مصنوعی مولد که ما در Copilot یا سایر محصولات ارائه می دهیم استفاده نخواهد شد.

ما می دانیم که مشتریان تجاری الزامات انطباق متفاوتی در صنایع و سراسر جهان دارند. Microsoft به این سازمان ها کمک می کند تا از مرزهای مستاجر و سایر کنترل هایی که ما ارائه می دهیم برای شناسایی و مدیریت داده های متعلق به آنها، به طور جداگانه، استفاده کنند.

بله، برخی از مکالمات Copilot هم برای بهبود محصول و هم برای اهداف ایمنی دیجیتال مورد بررسی خودکار و انسانی قرار می گیرند. به عنوان مثال، برای ساخت، آموزش و بهبود دقت روش های پردازش خودکار خود (از جمله هوش مصنوعی یا هوش مصنوعی)، به صورت دستی برخی از خروجی های تولید شده توسط روش های خودکار را در برابر داده های زیربنایی بررسی می کنیم. ما بازخورد انسانی از مربیان و کارمندان هوش مصنوعی را در فرآیند آموزشی خود قرار می دهیم. به عنوان مثال، بازخورد انسانی که خروجی با کیفیت را به درخواست کاربر تقویت می کند و تجربه کاربر نهایی را بهبود می بخشد.

همچنین ممکن است مکالماتی را که به عنوان نقض منشور اخلاقی در شرایط علامت گذاری شده اند، بررسی کنیم. منشور اخلاقی ما استفاده از سرویس Copilot برای ایجاد یا اشتراک گذاری محتوا یا مطالب نامناسب را ممنوع می کند. برخی از مکالمات زمانی بررسی می شوند که مشکوک به نقض منشور اخلاقی باشد.

در صورت مشکوک بودن به نقض آیین نامه رفتاری، بررسی انسانی محدود به عنوان بخشی از فرآیند تحقیق مورد نیاز است. برای اطمینان از ایمن و ایمن بودن سرویس های ما برای همه، انصراف کامل از بازبینی انسانی در دسترس نیست.

بله، می توانید از آموزش هوش مصنوعی انصراف دهید و همچنان شخصی سازی را روشن کنید. در این مورد، Copilot مکالمات اخیر را به خاطر می آورد تا پاسخ شخصی تری به شما بدهد، اما مایکروسافت از مکالمات شما و سایر فعالیت های مایکروسافت برای آموزش مدل هوش مصنوعی مولد استفاده نخواهد کرد. به عنوان مثال، Copilot هنگام پیشنهاد دستور العمل های شام، به یاد می آورد که شما گیاهخوار هستید.

ما داده های شما را بدون اجازه شما با اشخاص ثالث یا شرکا برای اهداف آموزشی هوش مصنوعی به اشتراک نمی گذاریم.

مکالمات شما با Copilot، مانند پرسش ها و پاسخ ها، به اشخاص ثالث افشا یا فروخته نمی شود، به جز موارد محدود زیر:

Microsoft برخی از داده های شخصی را مطابق با اعلامیه حریم خصوصی Microsoft ما با اشخاص ثالث به اشتراک می گذارد. به عنوان مثال، ممکن است داده های شخصی شما را با شرکت های وابسته و تابعه تحت کنترل Microsoft، با فروشندگانی که از طرف ما کار می کنند و در صورت لزوم توسط قانون یا برای پاسخگویی به روند قانونی، به اشتراک بگذاریم.

برای بهبود ایمنی و توانایی Copilot در تشخیص خطرات، تیم Copilot با سازمان های تحقیقاتی خارجی برای بررسی و ارزیابی گزارش های Copilot همکاری می کند. به عنوان مثال، سازمان های تحقیقاتی خارجی می توانند به بررسی گزارش های مکالمه Copilot کمک کنند تا انواع پرس و جوهای مورد استفاده برای جستجوی محتوای افراطی را درک کنند، روندها را در سراسر صنعت مقایسه کنند و تکنیک هایی را برای یافتن بهتر و کاهش آسیب توصیه کنند.

- * موجود بودن و قابلیتهای این ویژگی ممکن است بسته به نوع دستگاه، بازار، و نسخه مرورگر متفاوت باشد.

- * ممکن است محتوای این صفحه با استفاده از هوش مصنوعی ترجمه شده باشد.