Menavigasi ancaman cyber dan memperkuat pertahanan di era AI

Dunia keamanan cyber saat ini sedang mengalami transformasi besar. Kecerdasan buatan (AI) berada di garis depan dalam perubahan ini dan menjadi suatu ancaman sekaligus peluang. Meskipun AI berpotensi memungkinkan organisasi mengalahkan serangan cyber dengan kecepatan mesin serta mendorong inovasi dan efisiensi dalam deteksi ancaman, perburuan, dan respons terhadap insiden, pihak-pihak yang tidak bertanggung jawab dapat menggunakan AI sebagai bagian dari eksploitasi mereka. Saat ini sangat penting bagi kami untuk mendesain, menyebarkan, dan menggunakan AI dengan aman.

Di Microsoft, kami mengeksplorasi potensi AI untuk meningkatkan langkah-langkah keamanan kami, menghadirkan perlindungan baru dan tingkat lanjut, dan menciptakan perangkat lunak yang lebih baik. Berkat AI, kami memiliki kemampuan beradaptasi terhadap perkembangan ancaman, mendeteksi anomali secara instan, merespons dengan cepat untuk menetralkan risiko, dan menyesuaikan pertahanan untuk kebutuhan organisasi.

AI juga dapat membantu kami mengatasi tantangan terbesar lainnya dalam industri ini. Dalam masalah kurangnya jumlah tenaga kerja keamanan cyber global (sekitar 4 juta profesional keamanan cyber dibutuhkan di seluruh dunia), AI berpotensi menjadi alat penting untuk mengatasi masalah tersebut dan membantu meningkatkan produktivitas tenaga kerja keamanan.

Sebuah studi menunjukkan bagaimana Copilot for Security dapat membantu analis keamanan apa pun tingkat keahlian mereka dan di semua tugas, serta menjadi 44% lebih akurat dan 26% lebih cepat.

Untuk menciptakan masa depan yang aman, kita harus memastikan tercapainya keseimbangan antara persiapan AI yang aman dan penggunaan manfaatnya, karena AI memiliki kekuatan untuk meningkatkan potensi manusia dan memecahkan beberapa tantangan terberat yang kita hadapi.

Penggunaan AI untuk meningkatkan keamanan masa mendatang memerlukan kemajuan mendasar dalam rekayasa perangkat lunak. Hal ini mengharuskan kita untuk memahami dan memerangi ancaman yang didukung oleh AI sebagai komponen penting dari setiap strategi keamanan. Selain itu, kita harus bekerja sama guna menciptakan kolaborasi dan kemitraan yang mendalam antara sektor publik dan swasta untuk memerangi pelaku kejahatan.

Sebagai bagian dari upaya ini dan Inisiatif Secure Future kami, OpenAI dan Microsoft hari ini menerbitkan informasi inteligensi baru yang menjabarkan upaya pelaku ancaman untuk menguji dan mengeksplorasi kegunaan model bahasa besar (LLM) dalam teknik serangan.

Kami berharap informasi ini akan berguna bagi semua industri seiring upaya kita untuk menciptakan masa depan yang lebih aman. Karena pada akhirnya, kita semua memiliki peran dalam menjaga keamanan.

CVP, Chief Cybersecurity Advisor

Saksikan pengarahan digital Cyber Signals yang menampilkan Vasu Jakkal, Corporate Vide President di Microsoft Security Business, mewawancarai ahli inteligensi ancaman utama terkait ancaman cyber di era AI, cara Microsoft menggunakan AI untuk meningkatkan keamanan, dan apa yang dapat dilakukan organisasi untuk membantu memperkuat pertahanan.

Penyerang mengeksplorasi teknologi AI

Lanskap ancaman cyber kini semakin menantang dengan penyerang yang semakin termotivasi, canggih, dan memiliki lebih banyak sumber daya. Pelaku ancaman dan staf keamanan sama-sama mengeksplorasi AI, termasuk LLM, untuk meningkatkan produktivitas mereka dan memanfaatkan platform yang dapat diakses yang sesuai dengan tujuan dan teknik serangan mereka.

Mengingat lanskap ancaman yang berkembang pesat, kami hari ini mengumumkan prinsip-prinsip Microsoft untuk memandu tindakan kami dalam memitigasi risiko pelaku ancaman, termasuk ancaman persisten tingkat lanjut (APT), manipulator persisten tingkat lanjut (APM), dan sindikat penjahat cyber, menggunakan platform dan API AI. Prinsip-prinsip ini mencakup identifikasi dan tindakan terhadap penggunaan AI oleh pelaku ancaman berbahaya, pemberitahuan ke penyedia layanan AI lainnya, kolaborasi dengan pemangku kepentingan lainnya, dan transparansi.

Meskipun motif dan kecanggihan pelaku ancaman berbeda-beda, mereka melakukan tindakan yang sama saat menyebarkan serangan. Tindakan ini mencakup pengintaian, seperti meneliti industri, lokasi, dan hubungan calon korban; penyusunan kode, termasuk peningkatan skrip perangkat lunak dan pengembangan program jahat; dan bantuan dalam mempelajari dan menggunakan bahasa manusia dan mesin.

Berkolaborasi dengan OpenAI, kami membagikan inteligensi ancaman yang menunjukkan bahwa pelaku ancaman terafiliasi negara yang terdeteksi (Forest Blizzard, Emerald Sleet, Crimson Sandstorm, Charcoal Typhoon, dan Salmon Typhoon) menggunakan LLM untuk meningkatkan operasi cyber.

Tujuan kemitraan riset Microsoft dengan OpenAI adalah untuk memastikan penggunaan teknologi AI seperti ChatGPT secara aman dan bertanggung jawab, menjunjung standar tertinggi penerapan yang etis untuk melindungi masyarakat dari potensi penyalahgunaan.

Penggunaan LLM oleh Emerald Sleet melibatkan penelitian terhadap lembaga think tank dan ahli politik Korea Utara, serta pembuatan konten yang kemungkinan akan digunakan dalam kampanye spear phishing. Emerald Sleet juga menggunakan LLM untuk memahami kerentanan yang sudah diketahui publik, memecahkan masalah teknis, dan untuk bantuan dalam menggunakan berbagai teknologi web.

Kelompok lain yang didukung Tiongkok, Salmon Typhoon, telah mengevaluasi efektivitas penggunaan LLM sepanjang tahun 2023 untuk mendapatkan informasi tentang topik yang berpotensi sensitif, atau terkait individu terkenal, geopolitik regional, pengaruh AS, dan urusan dalam negeri. Keterlibatan tentatif dengan LLM ini dapat mencerminkan adanya perluasan alat pengumpulan intelijen dan fase eksperimental dalam penilaian kemampuan teknologi baru.

Kami telah mengambil langkah-langkah untuk mendisrupsi aset dan akun yang terkait dengan pelaku ancaman ini dan membuat tembok serta mekanisme keselamatan di sekitar model kami.

Penipuan yang didukung AI menjadi masalah penting lainnya. Sintesis suara adalah contohnya. Sampel suara berdurasi tiga detik sudah cukup untuk melatih model agar berhasil menirukan suara siapa pun. Bahkan sesuatu yang tidak berbahaya seperti pesan suara Anda dapat digunakan untuk mendapatkan sampel yang memadai.

Sebagian besar cara kita berinteraksi satu sama lain dan menjalankan bisnis bergantung pada identifikasi, seperti pengenalan suara, wajah, alamat email, atau gaya penulisan seseorang.

Sangat penting bagi kita untuk memahami bagaimana pelaku kejahatan menggunakan AI untuk mengacaukan sistem pemeriksaan identitas yang sudah lama ada yang digunakan untuk mengatasi kasus penipuan kompleks dan ancaman rekayasa sosial lainnya yang mengaburkan identitas.

AI juga dapat digunakan untuk membantu perusahaan mendisrupsi upaya penipuan. Meskipun Microsoft telah menghentikan keterlibatan dengan sebuah perusahaan di Brasil, sistem AI kami mendeteksi upaya perusahaan tersebut untuk menciptakan ulang keterlibatannya agar dapat memasuki kembali ekosistem kami.

Kelompok ini terus berupaya mengaburkan informasinya, menyembunyikan akar kepemilikan, dan mencoba masuk kembali. Namun, deteksi AI kami menggunakan hampir puluhan sinyal risiko untuk menandai perusahaan ini sebagai penipu dan mengaitkannya dengan perilaku mencurigakan yang telah diketahui sebelumnya sehingga menghalangi upaya mereka.

Microsoft berkomitmen terhadap AI yang dipimpin manusia yang bertanggung jawab, dengan privasi dan keamanan dengan pengawasan, evaluasi sumber daya, dan interpretasi kebijakan dan peraturan oleh manusia.

- Menggunakan kebijakan akses bersyarat: Kebijakan ini memberikan panduan penyebaran mandiri yang jelas untuk memperkuat postur keamanan Anda yang secara otomatis akan melindungi penyewa berdasarkan sinyal risiko, lisensi, dan penggunaan. Kebijakan akses bersyarat dapat disesuaikan dan akan beradaptasi dengan perubahan lanskap ancaman cyber.

- Melatih dan melatih kembali karyawan tentang taktik rekayasa sosial: Beri edukasi ke karyawan dan masyarakat tentang cara mengenali dan bereaksi terhadap email pengelabuan, vishing (pesan suara), smishing, serangan rekayasa sosial (SMS/teks), dan menerapkan keamanan praktik terbaik untuk Microsoft Teams.

- Melindungi data dengan ketat: Pastikan data tetap bersifat pribadi dan terkontrol dari ujung ke ujung.

- Memanfaatkan alat keamanan AI Generatif: Alat seperti Microsoft Copilot for Security dapat menambah kemampuan dan meningkatkan postur keamanan organisasi.

- Mengaktifkan autentikasi multifaktor: Aktifkan autentikasi multifaktor untuk semua pengguna, terutama untuk fungsi administrator, karena autentikasi multifaktor mengurangi risiko pengambilalihan akun hingga lebih dari 99 persen.

Bertahan dari serangan

Microsoft mendeteksi lalu lintas berbahaya dalam jumlah yang besar dengan lebih dari 65 triliun sinyal keamanan cyber per hari. AI meningkatkan kemampuan kami untuk menganalisis informasi ini dan memastikan wawasan paling penting digunakan dalam membantu menghentikan ancaman. Kami juga menggunakan kecerdasan sinyal ini untuk meningkatkan AI Generatif untuk perlindungan ancaman tingkat lanjut, keamanan data, dan keamanan identitas guna membantu staf keamanan mengetahui hal-hal yang terlewatkan oleh alat lain.

Microsoft menggunakan beberapa metode untuk melindungi dirinya dan pelanggan dari ancaman cyber, termasuk deteksi ancaman yang didukung AI untuk mendeteksi perubahan dalam cara penggunaan sumber daya atau lalu lintas di jaringan; analisis perilaku untuk mendeteksi proses masuk riskan dan perilaku ganjil; model pembelajaran mesin (ML) untuk mendeteksi proses masuk riskan dan program jahat; model Zero Trust yang membuat setiap permintaan akses harus sepenuhnya diautentikasi, diotorisasi, dan dienkripsi; dan verifikasi kondisi perangkat sebelum perangkat dapat terhubung ke jaringan perusahaan.

Kami menemukan bahwa penyerang memanfaatkan rekayasa sosial dalam upaya untuk membahayakan karyawan karena mereka tahu bahwa Microsoft menerapkan autentikasi multifaktor (MFA) secara ketat untuk melindungi diri (semua karyawan kami telah menerapkan MFA atau perlindungan tanpa kata sandi).

Area yang sering menjadi target adalah area berisi hal-hal penting disampaikan, seperti coba gratis atau harga promosi layanan atau produk. Di area ini, tidaklah menguntungkan bagi penyerang untuk mencuri satu langganan dalam satu waktu. Oleh karena itu, mereka berupaya melakukan dan meningkatkan serangan tersebut tanpa terdeteksi.

Tentu saja, kami membangun model AI untuk mendeteksi serangan ke Microsoft dan pelanggan kami ini. Kami mendeteksi akun siswa dan sekolah palsu, perusahaan atau organisasi palsu yang telah mengubah data perusahaan atau menyembunyikan identitas asli mereka untuk menghindari sanksi, menghindari kontrol, atau menyembunyikan pelanggaran kriminal di masa lalu seperti hukuman korupsi, upaya pencurian, dll.

Penggunaan GitHub Copilot, Microsoft Copilot for Security, dan fitur obrolan kopilot lainnya yang terintegrasi ke dalam infrastruktur operasi dan teknis internal kami membantu mencegah insiden yang dapat berdampak pada operasi.

Untuk mengatasi ancaman email, Microsoft meningkatkan kemampuan untuk mengumpulkan sinyal (selain komposisi email) untuk memahami apakah email tersebut berbahaya. Penggunaan AI oleh pelaku ancaman memunculkan banyak email yang ditulis secara sempurna dan tanpa kesalahan bahasa serta tata bahasa yang sering kali digunakan untuk mengenali upaya pengelabuan, yang membuatnya lebih sulit untuk dideteksi.

Edukasi karyawan yang berkelanjutan dan kampanye kesadaran masyarakat diperlukan untuk membantu memerangi rekayasa sosial, yang merupakan satu-satunya serangan yang 100% bergantung pada kesalahan manusia. Sejarah telah mengajarkan kita bahwa kampanye kesadaran masyarakat yang efektif telah berhasil mengubah perilaku.

Microsoft memperkirakan bahwa AI akan mengembangkan taktik rekayasa sosial, menciptakan serangan yang lebih canggih termasuk deepfake dan kloning suara, terutama jika penyerang menemukan teknologi AI dioperasikan tanpa praktik yang bertanggung jawab dan kontrol keamanan bawaan.

Pencegahan adalah kunci untuk memerangi semua ancaman cyber, baik yang bersifat tradisional maupun yang didukung oleh AI.

Rekomendasi:

Dapatkan wawasan lainnya seputar AI dari Homa Hayatafar, Principal Data and Applied Science Manager, Detection Analytics Manager.

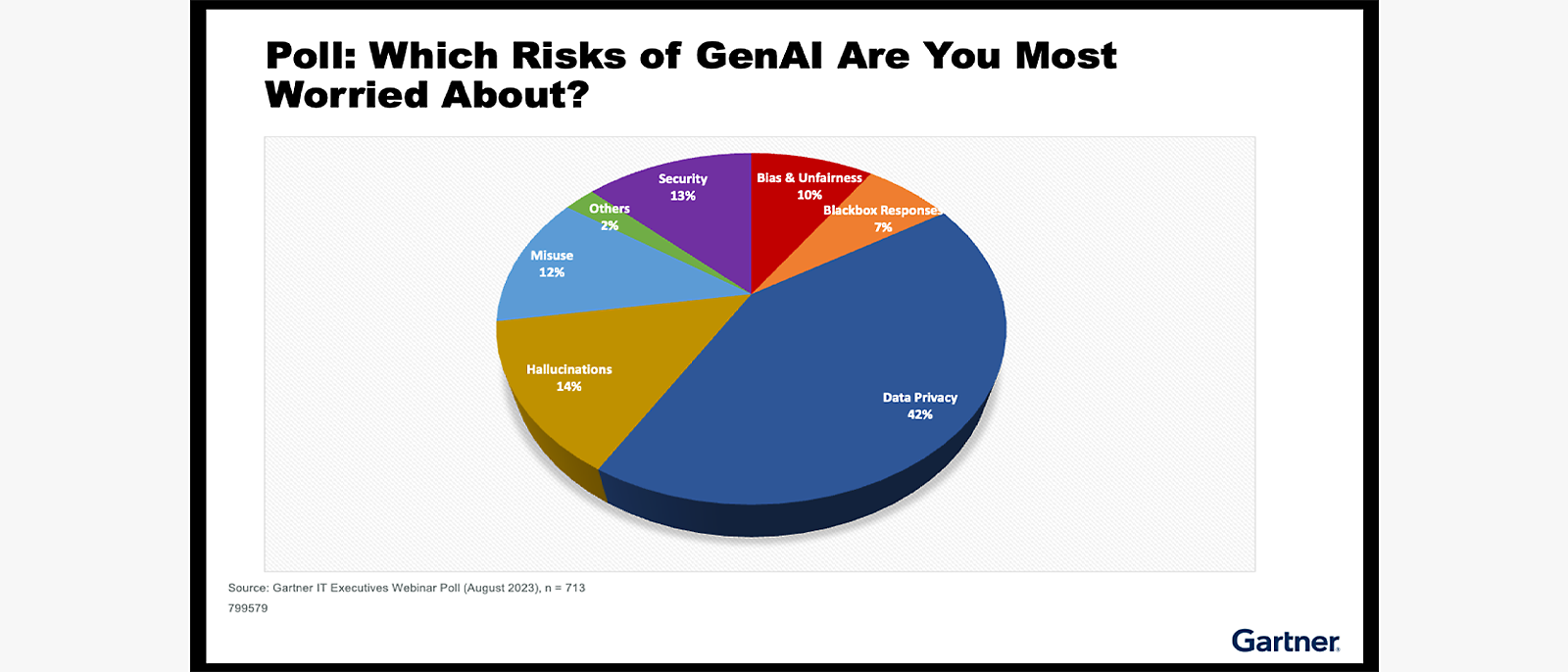

Alat tradisional tidak lagi mampu mengimbangi ancaman yang ditimbulkan oleh penjahat cyber. Meningkatnya kecepatan, skala, dan kecanggihan serangan cyber akhir-akhir ini menuntut adanya pendekatan baru terkait keamanan. Selain itu, masalah kurangnya jumlah tenaga kerja keamanan cyber yang disertai meningkatnya frekuensi serta keparahan ancaman cyber juga harus segera diatasi.

AI dapat sangat membantu tenaga kerja keamanan. Sebuah studi terbaru tentang Microsoft Copilot for Security (saat ini sedang dalam pengujian pratinjau pelanggan) menunjukkan peningkatan kecepatan dan akurasi analis keamanan, apa pun tingkat keahlian mereka, pada tugas-tugas umum seperti mengidentifikasi skrip yang digunakan oleh penyerang, membuat laporan insiden, dan mengidentifikasi langkah-langkah remediasi yang tepat.1

- [1]

Metodologi:1 Data snapshot merepresentasikan percobaan terkontrol secara acak (RCT), dengan kami menguji 149 orang untuk mengukur dampak produktivitas dari penggunaan Microsoft Copilot for Security. Dalam RCT ini, kami secara acak memberi Copilot kepada beberapa analis dan bukan yang lain, lalu mengurangi kinerja dan sentimen mereka untuk mendapatkan efek Copilot, terpisah dari efek dasar apa pun. Subjek tes memiliki keterampilan TI dasar, tetapi masih pemula di bidang keamanan, sehingga kami dapat menguji bagaimana Copilot membantu analis “yang baru berkarier”. RCT Microsoft Copilot for Security dilakukan oleh Microsoft Office of the Chief Economist, November 2023. Selain itu, Microsoft Entra ID menyediakan data anonim tentang aktivitas ancaman, seperti akun email berbahaya, email pengelabuan, dan pergerakan penyerang dalam jaringan. Wawasan tambahan berasal dari 65 triliun sinyal keamanan harian yang diperoleh di seluruh Microsoft, termasuk cloud, titik akhir, edge cerdas, Tim Deteksi dan Respons dan Praktik Pemulihan Keamanan Ancaman, telemetri dari platform dan layanan Microsoft termasuk Microsoft Defender, dan Laporan Pertahanan Digital Microsoft 2023.