Bringe AI oversettelse til kantenheter med Microsoft Translator

Inne november måned 2016, Microsoft brakt fordelen av AI-drevet apparat oversettelse, aka neural apparat oversettelse (NMT), å utviklerne og end brukernes ens. forrige uke Microsoft brakte NMT evne til kanten av skyen ved å utnytte NPU, en AI-dedikert prosessor integrert i Mate 10, Huawei ' s nyeste flaggskip telefon. Den nye brikken gjør AI-powered oversettelser tilgjengelig på enheten selv i fravær av Internett-tilgang, slik at systemet til å produsere oversettelser som kvalitet er på linje med det elektroniske systemet.

For å oppnå dette gjennombruddet, samarbeidet forskere og ingeniører fra Microsoft og Huawei i å tilpasse nevrale oversettelse til dette nye datamiljøet.

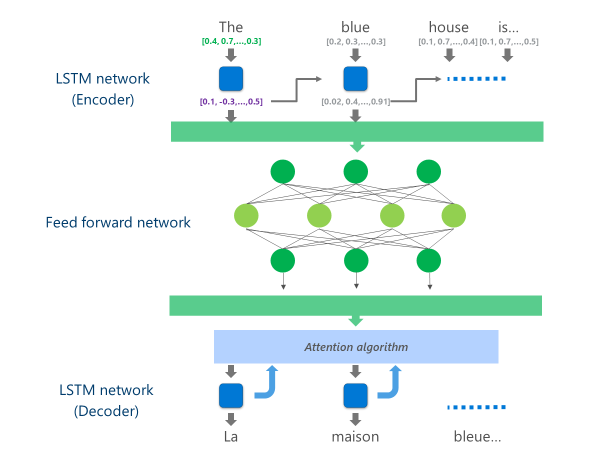

Den mest avanserte NMT systemer for tiden i produksjon (dvs. brukes i skala i skyen av bedrifter og programmer) bruker et nettverk arkitektur som kombinerer flere lag med LSTM-nettverk, en oppmerksomhet algoritme, og en oversettelse (dekoder) lag.

Animasjonen nedenfor forklarer, på en forenklet måte, hvordan dette multi-lags nevrale nettverk fungerer. Hvis du vil ha mer informasjon, kan du seHva er maskinen oversettelse siden"på webområdet Microsoft Translator.

I denne skyen NMT gjennomføringen, disse midt LSTM lag forbruke en stor del av databehandling makt. For å kunne kjøre full NMT på en mobil enhet, var det nødvendig å finne en mekanisme som kan redusere disse beregningsorientert kostnadene samtidig bevare, så mye som mulig, oversettelsen kvalitet.

Det er her Huawei ' s neural Processing Unit (NPU) kommer inn i bildet. Microsoft forskere og ingeniører tok fordel av NPU, som er spesielt utviklet for å utmerke på lav-latency AI beregninger, for å avlaste operasjoner som ville ha vært uakseptabelt treg å behandle på de viktigste CPU.

Implementering

Implementeringen som nå er tilgjengelig i Microsoft Translator-appen for Huawei mate 10, optimaliserer oversettelsen ved å avlaste de mest regneintensive oppgavene til NPU.

Nærmere bestemt erstatter denne implementeringen disse midtre LSTM nettverks lagene med en dyp feed-frem nettverk. Dyp feed-Forward nevrale nettverk er kraftige, men krever svært store mengder beregning på grunn av den høye tilkoblingsmuligheter blant neurons.

Nevrale nettverk stole primært på matrise multiplikasjoner, en operasjon som ikke er komplisert fra et matematisk standpunkt, men veldig dyrt når det utføres på skalaen som kreves for en slik dyp nevrale nettverk. Den Huawei NPU utmerker seg i å utføre disse matrise multiplikasjoner i en massivt parallell måte. Det er også ganske effektivt fra et strømforbruk ståsted, en viktig kvalitet på batteridrevne enheter.

På hvert lag av denne feed-Forward nettverk, NPU beregner både rå Nevron utgang og den påfølgende ReLu aktivisering funksjonen effektivt og med svært lav latens. Ved å utnytte den store Høyhastighetsminne på NPU, utfører den disse beregninger parallelt uten å måtte betale kostnadene for dataoverføring (dvs. sakker ytelse) mellom CPU og NPU.

Når det siste laget av denne dype feed-Forward nettverket er beregnet, har systemet en rik representasjon av kilden språk setning. Denne representasjonen blir deretter matet gjennom en venstre mot høyre LSTM "dekoder" for å produsere hvert målspråk ord, med samme oppmerksomhet algoritmen som brukes i den elektroniske versjonen av NMT.

Som Anthony Aue, forklarer en Principal Software Development Engineer i Microsoft Translator-teamet: "tar et system som kjører på kraftige Sky servere i et datasenter og kjører det uendret på en mobiltelefon er ikke et levedyktig alternativ. Mobile enheter har begrensninger i datakraft, minne og strømforbruk som skyløsninger ikke har. Å ha tilgang til NPU, sammen med noen andre arkitektoniske tweaks, tillot oss å omgå mange av disse begrensningene og å designe et system som kan kjøre raskt og effektivt på enheten uten å måtte kompromittere Oversettelses kvalitet."

Implementeringen av disse Oversettelses modellene på den innovative NPU-brikkesettet tillot Microsoft og Huawei å levere på enheten neural Translation med en kvalitet som kan sammenlignes med Sky-baserte systemer, selv når du er utenfor nettet.