การจัดการภัยคุกคามทางไซเบอร์และการเสริมสร้างการป้องกันในยุคของ AI

โลกแห่งการรักษาความปลอดภัยทางไซเบอร์ในปัจจุบันกำลังเผชิญกับการเปลี่ยนแปลงครั้งใหญ่ ปัญญาประดิษฐ์ (AI) ถือเป็นตัวตั้งตัวตีของการเปลี่ยนแปลงครั้งนี้ ซึ่งก่อให้เกิดทั้งภัยคุกคามและโอกาส ในขณะที่ AI มีศักยภาพในการยกระดับองค์กรเพื่อเอาชนะการโจมตีทางไซเบอร์ด้วยความเร็วของเครื่อง และขับเคลื่อนนวัตกรรมและประสิทธิภาพในการตรวจหาภัยคุกคาม การไล่ล่า และการตอบสนองต่อเหตุการณ์ ฝ่ายปรปักษ์เองก็สามารถใช้ AI เป็นส่วนหนึ่งของการแสวงหาประโยชน์ได้เช่นกัน การออกแบบ ปรับใช้ และใช้ AI อย่างปลอดภัยไม่เคยมีความสำคัญในระดับนี้มาก่อนสำหรับเรา

ที่ Microsoft เรากำลังสำรวจศักยภาพของ AI เพื่อยกระดับมาตรการรักษาความปลอดภัย ปลดล็อกการป้องกันขั้นสูงในรูปแบบใหม่ และสร้างสรรค์ซอฟต์แวร์ที่ดีขึ้น AI ช่วยให้เรามีประสิทธิภาพในการปรับตัวเพื่อรับมือกับภัยคุกคามที่พัฒนาอย่างต่อเนื่อง ตรวจหาความผิดปกติได้ทันที ตอบสนองได้อย่างรวดเร็วเพื่อลดความเสี่ยง และปรับแต่งการป้องกันให้ตรงกับความต้องการขององค์กร

AI ยังสามารถช่วยให้เราเอาชนะความท้าทายที่ใหญ่ที่สุดอีกประการหนึ่งของอุตสาหกรรมได้อีกด้วย เมื่อเผชิญกับปัญหาการขาดแคลนบุคลากรด้านการรักษาความปลอดภัยทางไซเบอร์ทั่วโลก โดยมีความต้องการผู้เชี่ยวชาญด้านการรักษาความปลอดภัยทางไซเบอร์ราว 4 ล้านคนทั่วโลก AI จึงมีศักยภาพที่จะเป็นเครื่องมือสำคัญในการปิดช่องว่างจากการขาดบุคลากรที่มีความสามารถและช่วยให้ผู้ป้องกันมีประสิทธิภาพการทำงานมากขึ้น

เราได้รับทราบจากการศึกษาชิ้นหนึ่งแล้วถึงวิธีการที่ Copilot สำหรับการรักษาความปลอดภัยสามารถช่วยเหลือนักวิเคราะห์ด้านการรักษาความปลอดภัยโดยไม่คำนึงถึงระดับความเชี่ยวชาญในงานทุกประเภท โดยผู้เข้าร่วมทำงานได้อย่างแม่นยำมากขึ้น 44 เปอร์เซ็นต์และเร็วขึ้น 26 เปอร์เซ็นต์

ในขณะที่เรามองหาอนาคตที่มั่นคงปลอดภัย เราต้องแน่ใจว่ามีสมดุลในการเตรียมการอย่างปลอดภัยสำหรับ AI และการใช้ประโยชน์จากเทคโนโลยีดังกล่าว เนื่องจาก AI มีประสิทธิภาพในการยกระดับศักยภาพของมนุษย์และแก้ไขความท้าทายที่สำคัญที่สุดของเรา

อนาคตที่ปลอดภัยยิ่งขึ้นด้วย AI จะต้องพึ่งพาความก้าวหน้าในระดับพื้นฐานด้านวิศวกรรมซอฟต์แวร์ ซึ่งกำหนดให้เราต้องรับทราบและตอบโต้ภัยคุกคามที่ขับเคลื่อนด้วย AI ซึ่งเป็นองค์ประกอบสำคัญของกลยุทธ์ด้านการรักษาความปลอดภัย และเราต้องทำงานร่วมกันเพื่อสร้างการทำงานร่วมกันและความร่วมมือในเชิงลึกระหว่างภาครัฐและเอกชนเพื่อรับมือกับผู้ดำเนินการที่ไม่ประสงค์ดี

ในฐานะส่วนหนึ่งของความพยายามครั้งนี้และโครงการริเริ่ม Secure Future Initiative ของเราเอง วันนี้ OpenAI และ Microsoft ได้เผยแพร่ข้อมูลข่าวกรองใหม่ที่ให้รายละเอียดเกี่ยวกับความพยายามของผู้ดำเนินการภัยคุกคามในการทดสอบและสำรวจการใช้ประโยชน์จากโมเดลภาษาขนาดใหญ่ (LLM) ในเทคนิคการโจมตี

เราหวังว่าข้อมูลนี้จะเป็นประโยชน์ในอุตสาหกรรมต่างๆ ในขณะที่เราทุกคนมุ่งไปสู่อนาคตที่ปลอดภัยยิ่งขึ้น เพราะในท้ายที่สุดแล้ว เราทุกคนล้วนเป็นผู้ป้องกันด้วยกันทั้งสิ้น

CVP และหัวหน้าที่ปรึกษาด้านการรักษาความปลอดภัยทางไซเบอร์

รับชมการบรรยายสรุปทางดิจิทัลของรายงานสัญญาณอันตรายทางไซเบอร์ โดยที่ Vasu Jakkal รองประธานองค์กรของ Microsoft Security Business จะร่วมสัมภาษณ์ผู้เชี่ยวชาญด้านข่าวกรองเกี่ยวกับภัยคุกคามคนสำคัญเกี่ยวกับภัยคุกคามทางไซเบอร์ในยุคของ AI, วิธีการที่ Microsoft ใช้ AI เพื่อยกระดับการรักษาความปลอดภัย และสิ่งที่องค์กรสามารถทำได้เพื่อช่วยเสริมสร้างการป้องกัน

ผู้โจมตีกำลังสำรวจเทคโนโลยี AI ต่างๆ

ภูมิทัศน์ของภัยคุกคามทางไซเบอร์มีความท้าทายเพิ่มมากขึ้น โดยผู้โจมตีมีแรงจูงใจมากขึ้น มีความซับซ้อนในการโจมตีมากขึ้น และมีทรัพยากรที่ดีขึ้น ผู้ดำเนินการภัยคุกคามและผู้ปกป้องต่างก็พิจารณาที่จะใช้ประโยชน์จาก AI รวมถึง LLM เพื่อยกระดับประสิทธิภาพการทำงาน และใช้ประโยชน์จากแพลตฟอร์มที่สามารถเข้าถึงได้ซึ่งเหมาะสมกับวัตถุประสงค์และเทคนิคการโจมตีของตน

เมื่อพิจารณาถึงภูมิทัศน์ของภัยคุกคามที่พัฒนาอย่างรวดเร็ว วันนี้เราจึงประกาศหลักการของ Microsoft ที่เป็นแนวทางในการดำเนินการของเราเพื่อลดความเสี่ยงจากผู้ดำเนินการภัยคุกคาม รวมถึงภัยคุกคามต่อเนื่องขั้นสูง (APT) นักปลุกปั่นต่อเนื่องขั้นสูง (APM) และกลุ่มอาชญากรไซเบอร์โดยใช้แพลตฟอร์ม AI และ API หลักการเหล่านี้ประกอบด้วยการระบุตัวตนและการดำเนินการต่อต้านการใช้ AI ของผู้ดำเนินการภัยคุกคามที่มุ่งร้าย, การแจ้งเตือนผู้ให้บริการ AI รายอื่นทราบ, การทำงานร่วมกันกับผู้เกี่ยวข้องรายอื่น และความโปร่งใส

แม้ว่าแรงจูงใจและความซับซ้อนของผู้ดำเนินการภัยคุกคามจะแตกต่างกันไป แต่พวกเขาก็มีภารกิจร่วมกันเมื่อก่อเหตุโจมตี ภารกิจเหล่านี้รวมถึงการสอดแนม เช่น การสืบหาข้อมูลอุตสาหกรรม ตำแหน่งที่ตั้ง และความสัมพันธ์ของผู้ที่อาจตกเป็นเหยื่อ, การเขียนโค้ดซึ่งรวมถึงการปรับปรุงสคริปต์ซอฟต์แวร์และการพัฒนามัลแวร์ และการให้ความช่วยเหลือในการเรียนรู้และการใช้ทั้งภาษามนุษย์และภาษาเครื่อง

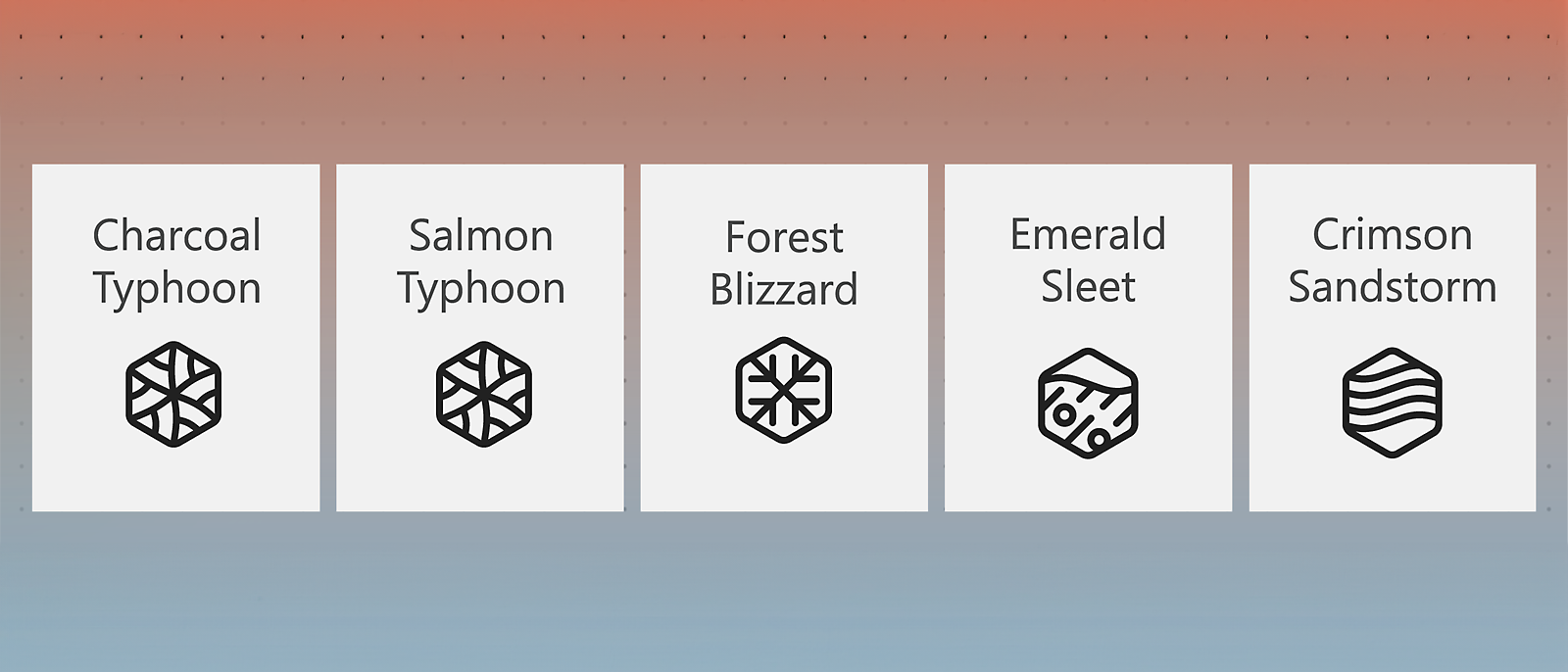

เราทำงานร่วมกันกับ OpenAI เพื่อแบ่งปันข่าวกรองเกี่ยวกับภัยคุกคามที่แสดงข้อมูลฝ่ายปรปักษ์ที่กำกับดูแลโดยรัฐบาลที่ตรวจพบ ซึ่งมีการติดตามกลุ่มเหล่านี้ในชื่อของ Forest Blizzard, Emerald Sleet, Crimson Sandstorm, Charcoal Typhoon และ Salmon Typhoon โดยใช้ LLM เพื่อเสริมการปฏิบัติงานทางไซเบอร์

วัตถุประสงค์ของความร่วมมือด้านการวิจัยของ Microsoft ร่วมกับ OpenAI คือเพื่อรับรองว่ามีการใช้เทคโนโลยี AI เช่น ChatGPT อย่างปลอดภัยและมีความรับผิดชอบ โดยรักษามาตรฐานสูงสุดของการประยุกต์ใช้อย่างมีจริยธรรมเพื่อปกป้องชุมชนจากการใช้งานในทางที่ผิดที่อาจเกิดขึ้น

การใช้ LLM ของ Emerald Sleet เกี่ยวข้องกับการวิจัยของคณะวิจัยและผู้เชี่ยวชาญเกี่ยวกับเกาหลีเหนือ รวมถึงการสร้างเนื้อหาที่มีแนวโน้มว่าจะได้รับการนำไปใช้ในแคมเปญสเปียร์ฟิชชิ่ง Emerald Sleet ยังโต้ตอบกับ LLM เพื่อรับทราบถึงช่องโหว่ที่สาธารณชนรับทราบ แก้ไขปัญหาทางเทคนิค และขอความช่วยเหลือในการใช้เทคโนโลยีเว็บต่างๆ อีกด้วย

อีกกลุ่มเคลื่อนไหวที่ได้รับการสนับสนุนจากจีนอย่าง Salmon Typhoon ได้ดำเนินการประเมินประสิทธิผลของการใช้ LLM ตลอดปี 2023 เพื่อจัดหาข้อมูลเกี่ยวกับหัวข้อที่อาจมีความละเอียดอ่อน บุคคลที่มีชื่อเสียง ภูมิรัฐศาสตร์ระดับภูมิภาค อิทธิพลของสหรัฐอเมริกา และกิจการภายใน การใช้ประโยชน์เบื้องต้นจาก LLM นี้อาจสะท้อนถึงการเพิ่มชุดเครื่องมือรวบรวมข้อมูลข่าวกรอง และระยะทดลองในการประเมินความสามารถของเทคโนโลยีอุบัติใหม่

เราได้ดำเนินการตามมาตรการต่างๆ เพื่อขัดขวางแอสเซทและบัญชีที่เกี่ยวข้องกับผู้ดำเนินการภัยคุกคามเหล่านี้ และกำหนดแนวทางป้องกันและกลไกด้านความปลอดภัยที่อยู่รายรอบโมเดลของเรา

การปลอมแปลงที่ขับเคลื่อนโดย AI ถือเป็นข้อกังวลที่สำคัญอีกประการหนึ่ง การสังเคราะห์เสียงเป็นตัวอย่างหนึ่งของข้อกังวลนี้ โดยที่คุณสามารถใช้ตัวอย่างเสียงเพียงสามวินาทีเพื่อฝึกโมเดลให้มีเสียงได้เหมือนทุกบุคคล แม้แต่สิ่งที่ไม่เป็นอันตรายอย่างคำทักทายในระบบข้อความเสียงของคุณก็สามารถใช้เพื่อสร้างตัวอย่างเสียงที่เพียงพอได้

วิธีที่เราโต้ตอบกันและดำเนินธุรกิจส่วนใหญ่พึ่งพา การพิสูจน์ตัวตน เช่น การจดจำเสียง ใบหน้า ที่อยู่อีเมล หรือรูปแบบการเขียนของบุคคล

จึงจำเป็นอย่างยิ่งที่เราต้องรับทราบถึงวิธีการที่ผู้ดำเนินการที่มุ่งร้ายใช้ AI เพื่อบ่อนทำลายระบบพิสูจน์ตัวตนที่มีมาอย่างยาวนาน เพื่อให้เราสามารถรับมือกับกรณีการปลอมแปลงที่ซับซ้อนและภัยคุกคามจากการโจมตีแบบวิศวกรรมสังคมอื่นๆ ที่อุบัติใหม่ซึ่งอำพรางตัวตนได้

เรายังสามารถใช้ AI เพื่อช่วยให้บริษัทต่างๆ ขัดขวางความพยายามในการปลอมแปลงได้อีกด้วย แม้ว่า Microsoft จะยุติการมีส่วนร่วมกับบริษัทในบราซิล แต่ระบบ AI ของเรายังคงตรวจพบความพยายามที่จะสร้างตัวตนขึ้นมาใหม่เพื่อกลับเข้าสู่ระบบนิเวศของเราอีกครั้ง

กลุ่มเคลื่อนไหวดังกล่าวพยายามอำพรางข้อมูลของตน ปกปิดผู้เป็นเจ้าของที่แท้จริง และกลับเข้าสู่ระบบอีกครั้งอย่างต่อเนื่อง แต่การตรวจหาด้วย AI ของเราใช้สัญญาณความเสี่ยงหลายสิบรายการเพื่อตั้งค่าสถานะของบริษัทที่หลอกลวง และเชื่อมโยงกับพฤติกรรมของผู้ต้องสงสัยที่มีการรับทราบข้อมูลก่อนหน้านี้เพื่อขัดขวางความพยายามของกลุ่มดังกล่าว

Microsoft มุ่งมั่นกับ การใช้งาน AI โดยมนุษย์ อย่างมีความรับผิดชอบ โดยคำนึงถึงความเป็นส่วนตัวและความปลอดภัยโดยมีมนุษย์คอยกำกับดูแล ประเมินคำอุทธรณ์ และตีความนโยบายและข้อบังคับ

- ใช้นโยบายการเข้าถึงแบบมีเงื่อนไข: นโยบายเหล่านี้ให้คำแนะนำที่ชัดเจนและปรับใช้ได้เองเพื่อเสริมความแข็งแกร่งให้กับเสถียรภาพการรักษาความปลอดภัยของคุณ ซึ่งจะปกป้องผู้เช่าโดยอัตโนมัติตามสัญญาณความเสี่ยง การให้สิทธิการใช้งาน และการใช้งาน นโยบายการเข้าถึงแบบมีเงื่อนไขสามารถกำหนดเองได้ และจะปรับตัวให้เข้ากับภูมิทัศน์ของภัยคุกคามทางไซเบอร์ที่เปลี่ยนแปลงไป

- ฝึกอบรมและฝึกอบรมปรับทักษะพนักงานเกี่ยวกับกลยุทการโจมตีแบบวิศวกรรมสังคม: ให้ความรู้แก่พนักงานและสาธารณชนเพื่อรับทราบและตอบสนองต่ออีเมลฟิชชิ่ง, วิชชิ่ง (ระบบข้อความเสียง), สมิชชิ่ง, การโจมตีแบบวิศวกรรมสังคม (SMS/ข้อความ) และนำแนวทางปฏิบัติด้านการรักษาความปลอดภัยสำหรับ Microsoft Teams ไปใช้

- ปกป้องข้อมูลอย่างเข้มงวด: รับรองว่าข้อมูลจะยังคงมีความเป็นส่วนตัวและได้รับการควบคุมตลอดกระบวนการ

- ใช้ประโยชน์จากเครื่องมือรักษาความปลอดภัยด้วย AI สร้างสรรค์: เครื่องมือต่างๆ เช่น Microsoft Copilot สำหรับการรักษาความปลอดภัยสามารถขยายขีดความสามารถและยกระดับเสถียรภาพการรักษาความปลอดภัยขององค์กรได้

- เปิดใช้งานการรับรองความถูกต้องโดยใช้หลายปัจจัย: ปิดใช้งานการรับรองความถูกต้องโดยใช้หลายปัจจัยสำหรับผู้ใช้ทั้งหมด โดยเฉพาะบุคคลที่มีหน้าที่เป็นผู้ดูแลระบบ เนื่องจากจะช่วยลดความเสี่ยงจากการถูกเข้ายึดบัญชีได้มากกว่า 99 เปอร์เซ็นต์

การป้องกันการโจมตี

Microsoft ตรวจพบปริมาณการใช้งานที่เป็นอันตรายจำนวนมหาศาล โดยมีสัญญาณด้านการรักษาความปลอดภัยทางไซเบอร์มากกว่า 65 ล้านล้านรายการต่อวัน AI ช่วยเพิ่มความสามารถของเราในการวิเคราะห์ข้อมูลนี้ และรับรองว่าจะมีการเปิดเผยข้อมูลเชิงลึกที่มีค่าที่สุดเพื่อช่วยหยุดยั้งภัยคุกคาม เรายังใช้ข่าวกรองจากสัญญาณนี้เพื่อขับเคลื่อน AI สร้างสรรค์สำหรับการป้องกันภัยคุกคามขั้นสูง การรักษาความปลอดภัยของข้อมูล และการรักษาความปลอดภัยของข้อมูลประจำตัว เพื่อช่วยให้ผู้ป้องกันรับทราบในสิ่งที่ผู้อื่นอาจพลาดไป

Microsoft ใช้หลายวิธีการในการปกป้องตนเองและลูกค้าจากภัยคุกคามทางไซเบอร์ รวมถึงการตรวจหาภัยคุกคามที่ใช้งาน AI เพื่อระบุการเปลี่ยนแปลงในวิธีการใช้ทรัพยากรหรือปริมาณการใช้งานบนเครือข่าย, การวิเคราะห์พฤติกรรมเพื่อตรวจหาการลงชื่อเข้าใช้ที่มีความเสี่ยงและพฤติกรรมที่ผิดปกติ, โมเดลการเรียนรู้ของเครื่อง (ML) เพื่อตรวจหาการลงชื่อเข้าใช้และมัลแวร์ที่มีความเสี่ยง, โมเดล Zero Trust ที่คำขอในการเข้าถึงทุกรายการจะต้องได้รับการรับรองความถูกต้อง อนุญาต และเข้ารหัสโดยสมบูรณ์ และการตรวจสอบสภาพการทำงานของอุปกรณ์ก่อนที่อุปกรณ์จะสามารถเชื่อมต่อกับเครือข่ายองค์กรได้

เนื่องจากผู้ดำเนินการภัยคุกคามรับทราบว่า Microsoft ใช้การรับรองความถูกต้องโดยใช้หลายปัจจัย (MFA) อย่างเข้มงวดเพื่อปกป้องตนเอง พนักงานของเราทุกคนจึงได้รับการตั้งค่าเพื่อใช้การป้องกันด้วย MFA หรือแบบไร้รหัสผ่าน และเราพบเห็นผู้โจมตีหันไปใช้การโจมตีแบบวิศวกรรมสังคมเพื่อพยายามโจมตีพนักงานของเรา

จุดที่เป็นอันตรายสำหรับการดำเนินการนี้ ได้แก่ พื้นที่ที่มีการนำเสนอสิ่งของมีค่า เช่น การทดลองใช้ฟรีหรือการกำหนดราคาโปรโมชันของบริการหรือผลิตภัณฑ์ ในพื้นที่เหล่านี้ ผู้โจมตีจะขโมยการสมัครใช้งานทีละรายการซึ่งอาจไม่ได้รับผลประโยชน์มากนัก ดังนั้นพวกเขาจึงพยายามดำเนินการและขยายการโจมตีเหล่านั้นโดยไม่ให้ถูกตรวจพบ

โดยปกติแล้ว เราสร้างโมเดล AI เพื่อตรวจหาการโจมตีเหล่านี้สำหรับ Microsoft และลูกค้าของเรา เราตรวจหานักเรียนและบัญชีโรงเรียนปลอม บริษัทหรือองค์กรปลอมที่เปลี่ยนแปลงข้อมูลเกี่ยวกับบริษัทหรือปกปิดตัวตนที่แท้จริงเพื่อหลีกเลี่ยงการลงโทษ หลบเลี่ยงการควบคุม หรือซ่อนการฝ่าฝืนทางอาญาในอดีต เช่น การพิพากษาลงโทษจากการทุจริต ความพยายามในการโจรกรรม ฯลฯ

การใช้ GitHub Copilot, Microsoft Copilot สำหรับการรักษาความปลอดภัย และฟีเจอร์การแชทอื่นๆ ของ Copilot ที่รวมอยู่ในโครงสร้างพื้นฐานด้านวิศวกรรมและการดำเนินการภายในของเรา จะช่วยป้องกันเหตุการณ์ที่อาจส่งผลกระทบต่อการปฏิบัติงาน

เพื่อจัดการกับภัยคุกคามทางอีเมล Microsoft กำลังปรับปรุงความสามารถในการรวบรวมสัญญาณต่างๆ ที่อยู่นอกเหนือจากองค์ประกอบของอีเมลเพื่อทำความเข้าใจว่าเป็นสัญญาณอันตรายหรือไม่ เมื่อ AI อยู่ในมือของผู้ดำเนินการภัยคุกคาม จึงทำให้มีอีเมลมากมายที่เขียนขึ้นอย่างสมบูรณ์แบบหลั่งไหลเข้ามาในระบบ ซึ่งมีการปรับปรุงข้อผิดพลาดทางภาษาและไวยากรณ์ที่มักจะพบเห็นได้อย่างชัดเจนจากความพยายามในการฟิชชิ่ง ทำให้ ตรวจหาความพยายามในการฟิชชิ่งได้ยากขึ้น

การให้ความรู้แก่พนักงานอย่างต่อเนื่องและการรณรงค์สร้างความตระหนักรู้ต่อสาธารณะถือเป็นสิ่งจำเป็นเพื่อช่วยรับมือกับการโจมตีแบบวิศวกรรมสังคม ซึ่งเป็นกลไกหนึ่งที่อาศัยข้อผิดพลาดของมนุษย์แบบ 100 เปอร์เซ็นต์ ประวัติศาสตร์ได้สอนเราว่าการรณรงค์เพื่อสร้างความตระหนักรู้ต่อสาธารณะที่มีประสิทธิภาพสามารถใช้เพื่อเปลี่ยนแปลงพฤติกรรมได้

Microsoft คาดการณ์ว่า AI จะพัฒนากลยุทธ์การโจมตีแบบวิศวกรรมสังคม โดยสร้างการโจมตีที่ซับซ้อนมากขึ้น รวมถึงสื่อลวงลึกและการโคลนเสียง โดยเฉพาะอย่างยิ่งหากผู้โจมตีพบว่าเทคโนโลยี AI ทำงานโดยไม่มี แนวทางปฏิบัติที่รับผิดชอบและการควบคุมการรักษาความปลอดภัยที่มีอยู่แล้วภายใน

การป้องกันถือเป็นกุญแจสำคัญในการรับมือกับภัยคุกคามทางไซเบอร์ทั้งหมด ไม่ว่าจะเป็นแบบดั้งเดิมหรือที่ใช้งาน AI

คำแนะนำ:

รับทราบข้อมูลเชิงลึกเพิ่มเติมเกี่ยวกับ AI จาก Homa Hayatafar ผู้จัดการฝ่ายข้อมูลและวิทยาศาสตร์ประยุกต์หลัก และผู้จัดการการวิเคราะห์ด้านการตรวจหา

เครื่องมือแบบดั้งเดิมไม่สามารถตามทันภัยคุกคามที่เกิดขึ้นจากอาชญากรไซเบอร์ได้อีกต่อไป ความเร็ว ขนาด และความซับซ้อนที่เพิ่มขึ้นของการโจมตีทางไซเบอร์เมื่อไม่นานนี้ทำให้มีความจำเป็นที่จะต้องมีแนวทางการรักษาความปลอดภัยแบบใหม่ นอกจากนี้ เนื่องจากปัญหาการขาดแคลนบุคลากรด้านการรักษาความปลอดภัยทางไซเบอร์และภัยคุกคามทางไซเบอร์ที่มีความถี่และความรุนแรงเพิ่มขึ้น การแก้ไขช่องว่างด้านทักษะจึงมีความจำเป็นเร่งด่วน

AI สามารถช่วยให้ผู้ป้องกันกุมความได้เปรียบ การศึกษาล่าสุดชิ้นหนึ่งเกี่ยวกับ Microsoft Copilot สำหรับการรักษาความปลอดภัย (ขณะนี้อยู่ในการทดสอบเวอร์ชันพรีวิวสำหรับลูกค้า) แสดงให้เห็นถึงความเร็วและความแม่นยำที่เพิ่มขึ้นของนักวิเคราะห์ด้านการรักษาความปลอดภัย โดยไม่คำนึงถึงระดับความเชี่ยวชาญในงานทั่วไป เช่น การระบุสคริปต์ที่ผู้โจมตีใช้ การสร้างรายงานเหตุการณ์ และการระบุขั้นตอนการแก้ไขที่เหมาะสม1

- [1]

ระเบียบวิธี:1 ข้อมูลสแนปช็อตแสดงถึงการทดลองแบบสุ่มและมีกลุ่มควบคุม (RCT) โดยเราได้ทดสอบจากบุคคล 149 คนเพื่อวัดผลกระทบด้านประสิทธิภาพการทำงานจากการใช้ Microsoft Copilot สำหรับการรักษาความปลอดภัย ใน RCT นี้ เรามอบ Copilot แบบสุ่มให้แก่นักวิเคราะห์เพียงบางรายและไม่ใช่ทุกราย จากนั้นจึงหักลบประสิทธิภาพและความรู้สึกของนักวิเคราะห์ออกเพื่อให้รับทราบถึงผลกระทบที่แท้จริงของ Copilot โดยแยกออกจากผลกระทบพื้นฐาน ผู้ร่วมการทดสอบมีทักษะด้าน IT ขั้นพื้นฐาน แต่เป็นมือใหม่ด้านการรักษาความปลอดภัย ดังนั้นเราจึงสามารถทดสอบได้ถึงวิธีการที่ Copilot ช่วยนักวิเคราะห์ “หน้าใหม่ในวงการ” RCT ของ Microsoft Copilot สำหรับการรักษาความปลอดภัยดำเนินการโดย Microsoft Office ของ Chief Economist, พฤศจิกายน 2023 นอกจากนี้ Microsoft Entra ID ยังให้ข้อมูลที่ไม่ระบุชื่อเกี่ยวกับกิจกรรมภัยคุกคาม เช่น บัญชีอีเมลที่เป็นอันตราย อีเมลฟิชชิ่ง และการเคลื่อนไหวของผู้โจมตีภายในเครือข่ายอีกด้วย ข้อมูลเชิงลึกเพิ่มเติมมาจากสัญญาณด้านความปลอดภัย 65 ล้านล้านรายการที่ได้รับจาก Microsoft ในแต่ละวัน รวมถึงระบบคลาวด์ ตำแหน่งข้อมูล อุปกรณ์ปลายทางอัจฉริยะ ทีมแนวทางปฏิบัติในการกู้คืนด้านการรักษาความปลอดภัยในกรณีที่มีช่องโหว่และการตรวจหาและการตอบสนองของเรา การวัดและส่งข้อมูลทางไกลจากแพลตฟอร์มและบริการของ Microsoft รวมถึง Microsoft Defender และ Microsoft Digital Defense Report ปี 2023