Copilot тут, щоб допомогти

Copilot тут, щоб допомогти

Дізнайтеся більше про можливості вашого напарника

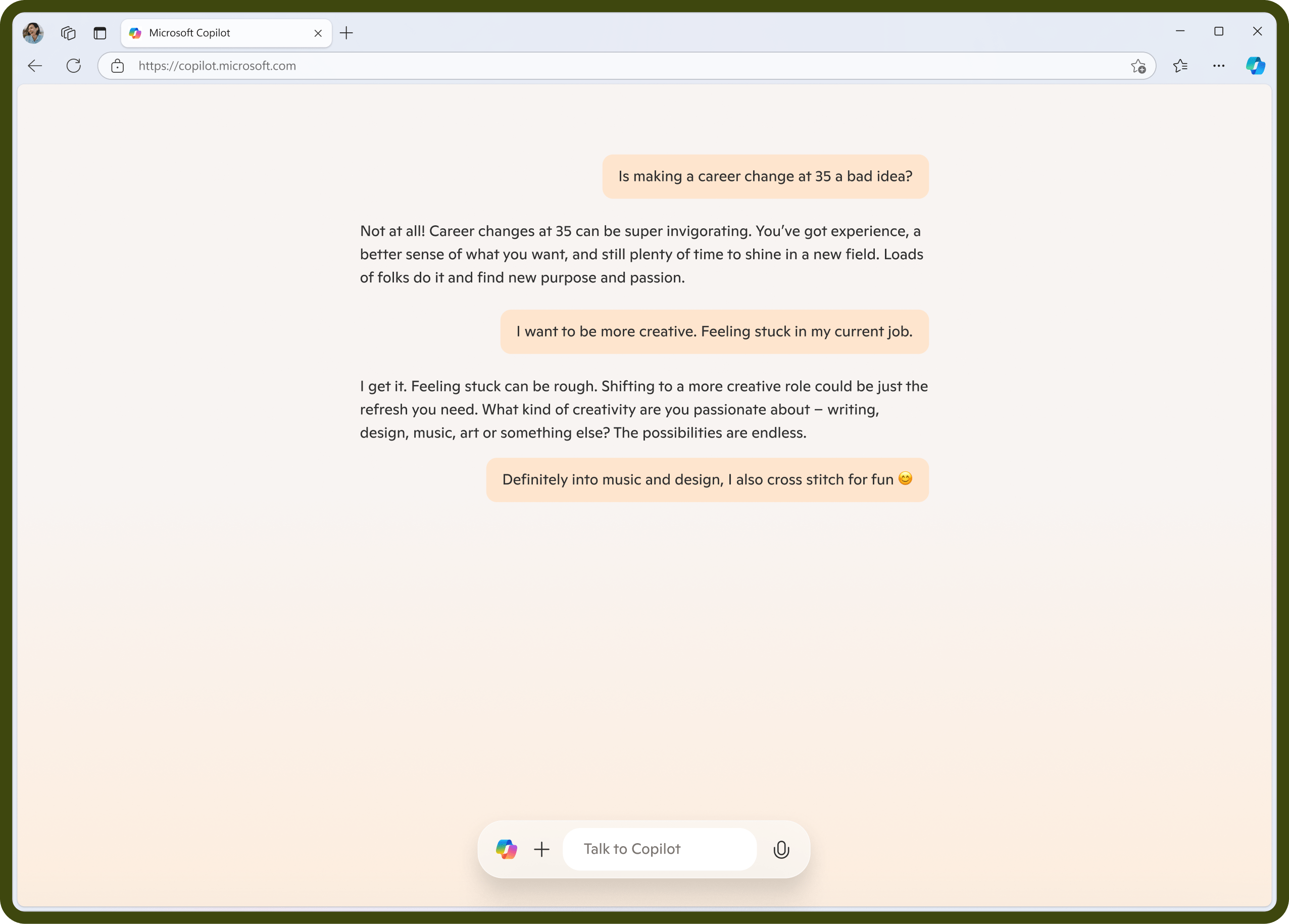

Супутник у будь-якому виклику

Супутник у будь-якому виклику

Copilot готовий дати пораду, відгук або корисне нагадування, щоб ви не збили зі шляху, коли ви вирішуєте великі та малі виклики.

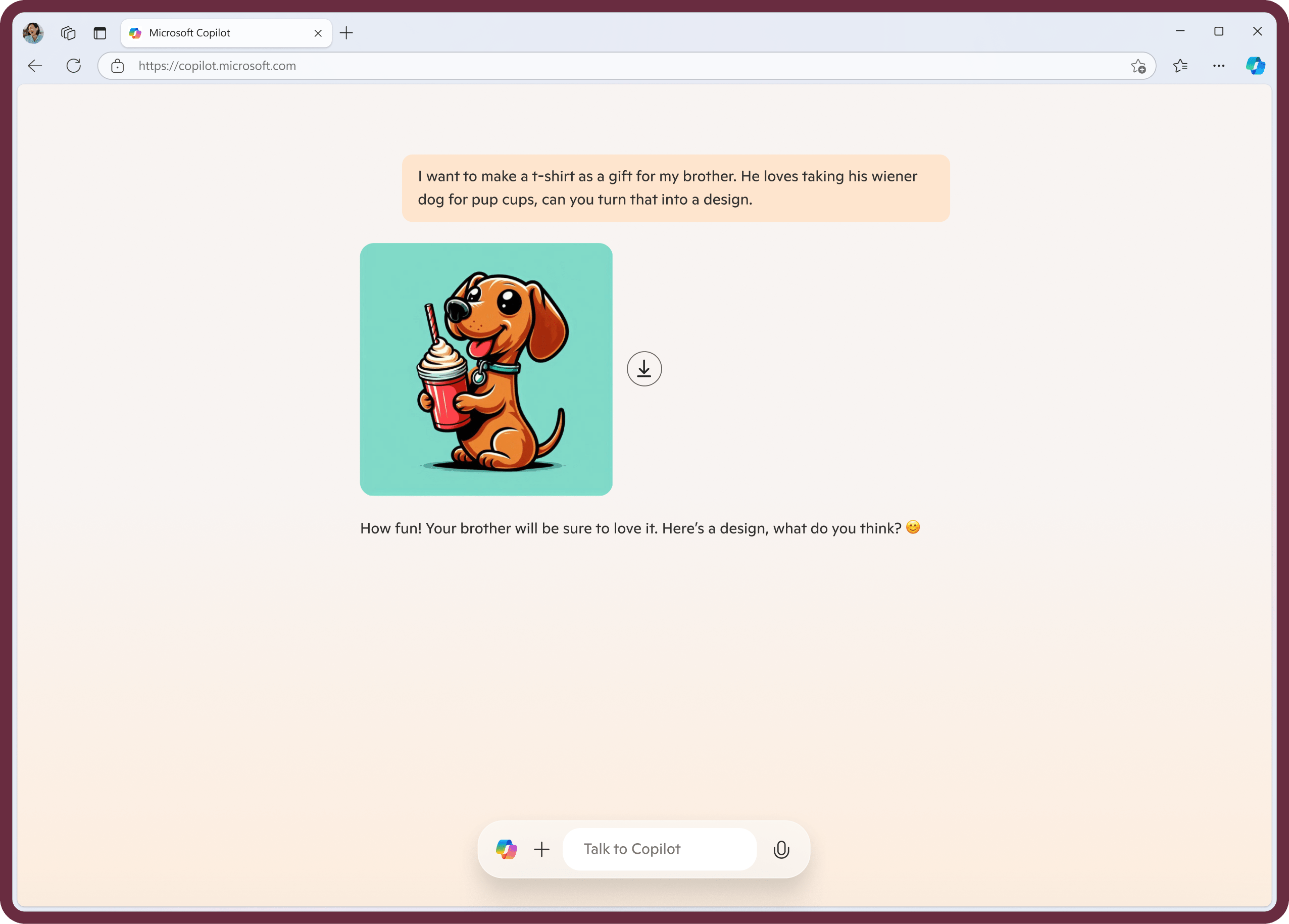

Зображення, письмо та багато іншого – Copilot може допомогти

Зображення, письмо та багато іншого – Copilot може допомогти

Перетворіть свої великі ідеї на реальні образи, спростіть процес дослідження та вдосконалюйте свої тексти, щоб ваш голос сяяв.

Отримуйте зрозумілі відповіді

Отримуйте зрозумілі відповіді

Copilot відповідає на ваші запитання та проводить вас через складні речі, роблячи речі легкими для розуміння. Незалежно від того, куди веде ваша цікавість, Copilot завжди поруч – направляти, уточнювати, спрощувати та підтримувати.

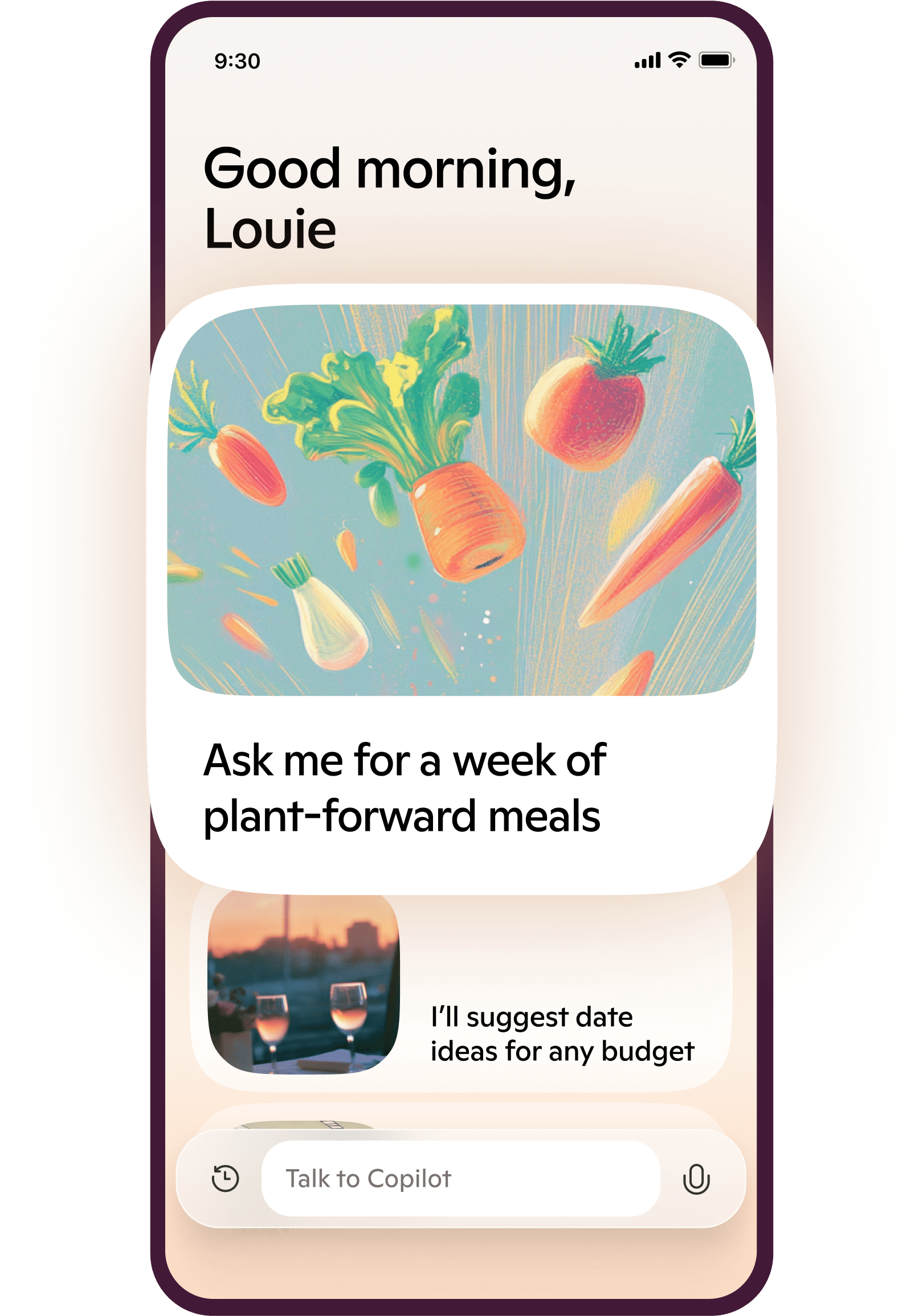

Спробуйте оновлений мобільний додаток Copilot

Спробуйте оновлений мобільний додаток Copilot

Завдяки свіжому дизайну та підвищеній надійності він став більш інтуїтивно зрозумілим, ніж будь-коли. Тепер Copilot плавно веде вас під час кожної взаємодії. А коли ви будете готові досліджувати далі, цитати полегшать перевірку та розширять деталі. Ви навіть можете використовувати свій голос для розмови, а ваші розмови та налаштування синхронізуватимуться на всіх ваших пристроях.

Спокійний. Впевнені. Другий пілот

Спокійний. Впевнені. Другий пілот

Кожен день приносить нові питання — виклики великі і малі. Ми всі могли б потребувати невеликої допомоги. Поштовх для початку або надійний партнер, який доставить вас до фінішу. У будь-який момент, з Copilot у вас є компаньйон, який тут, щоб допомогти.

Питання, що часто ставляться

Отримайте максимальну віддачу від Copilot

Отримайте максимальну віддачу від Copilot

Microsoft Copilot — це цифровий помічник на основі штучного інтелекту, призначений для участі в розмовах і допомоги людям із низкою завдань і дій на їхніх пристроях. Copilot може відповідати на запитання, створювати зображення або чернетки письмового вмісту, пропонувати різні способи формулювання того, що ви написали, і багато іншого.

Ми оновили Copilot, щоб відображати відгуки наших клієнтів. Цей новий Copilot — це швидший і спрощеніший досвід із новими функціями, які надають пріоритет персоналізації та служать надійним компаньйоном для штучного інтелекту.

Copilot Pro отримає ті ж оновлення, що і Copilot, з додатковими перевагами для передплатників. Клієнти можуть побачити ті самі візуальні зміни, більше використовувати голос Copilot, отримати ранній доступ до нових функцій штучного інтелекту через Copilot Labs і отримати пріоритетний доступ у години пік. Передплатники Copilot Pro також мають доступ до Copilot у вибраних програмах Microsoft 365.

Copilot — це як мати поруч із собою наукового асистента, особистого планувальника та творчого партнера. За допомогою Copilot ви можете:

- Задайте питання, дослідіть цікавинку або потренуйтеся в розмові. Коли ви ставите складні запитання, Copilot дає вам розгорнуті відповіді. Не соромтеся запитувати подальші дії, наприклад, «Чи можете ви пояснити це простіше?» або «Будь ласка, дайте мені більше варіантів».

- Отримайте реальну відповідь. Copilot переглядає результати пошуку в Інтернеті, щоб запропонувати вам узагальнену відповідь і посилання на свої джерела.

- Будьте креативними. Коли вам потрібне натхнення, Copilot може допомогти вам написати вірші, оповідання або навіть створити абсолютно новий образ. Copilot найкраще працює, коли ви більш описові, тому проявіть творчий підхід і додайте деталі, як-от прикметники, місця розташування або навіть художні стилі, як-от «цифрове мистецтво» та «фотореалістичний».

Кожна розмова з Copilot матиме обмежену кількість взаємодій, щоб розмова залишалася цікавою, актуальною та ґрунтувалася на пошуку.

Розмова з Copilot має здаватися природною. Вводьте текст або говоріть голосом — те, що найкраще підходить для розмови. Copilot автоматично розпізнає мову, яку ви використовуєте, і відповість відповідно. Ви також можете попросити Copilot говорити іншою мовою, але вона оптимізована для англійської.

Під час взаємодії Copilot може:

- Шукайте в Інтернеті так, щоб це було природно для того, як ви говорите, пишете текстові повідомлення або думаєте. Отримайте єдину, узагальнену відповідь із консолідованим набором посилань, або розгорнуту відповідь та джерела для більш складних запитань.

- Ставте додаткові запитання до початкового запитання або шукайте, щоб отримати більше корисних відповідей.

- Перефразуйте відповідь і зробіть речі простішими для розуміння. Просто скажіть щось на кшталт: «Чи можеш ти пояснити це простіше?».

- Відповідайте за допомогою різних форматів, як-от таблиця або нумерований список, коли ви про це просите.

- Допомагати писати вірші, оповідання, промови або ділитися ідеями для проєкту.

Коли ви підключаєте Copilot за допомогою голосу, корпорація Майкрософт зберігає голосові дані відповідно до нашої політики зберігання даних. Корпорація Майкрософт використовує голосові розмови та інші взаємодії з Copilot, щоб надавати та вдосконалювати службу, як зазначено в Декларації про конфіденційність Microsoft. Як було оголошено в серпні, ми також надаємо нашим клієнтам завчасне повідомлення про навчання наших генеративних моделей штучного інтелекту в Copilot на цих даних і надаємо чіткий і простий спосіб відмовитися від такого навчання. Ми впроваджуємо цю функцію поступово, щоб забезпечити дотримання законів про конфіденційність у всьому світі, і наразі не проводимо навчання на даних споживачів із Великої Британії, Європейської економічної зони (ЄЕЗ) та деяких інших країн.

Ви можете отримати доступ до Microsoft Copilot за адресою https://copilot.microsoft.com/, Microsoft Copilot для Android та iOS, програми Copilot у Windows або через Edge, натиснувши піктограму Copilot у верхньому правому куті. Щоб дізнатися поради щодо використання Copilot в Edge та інших функцій штучного інтелекту в браузері, відвідайте сторінку AI Tips.

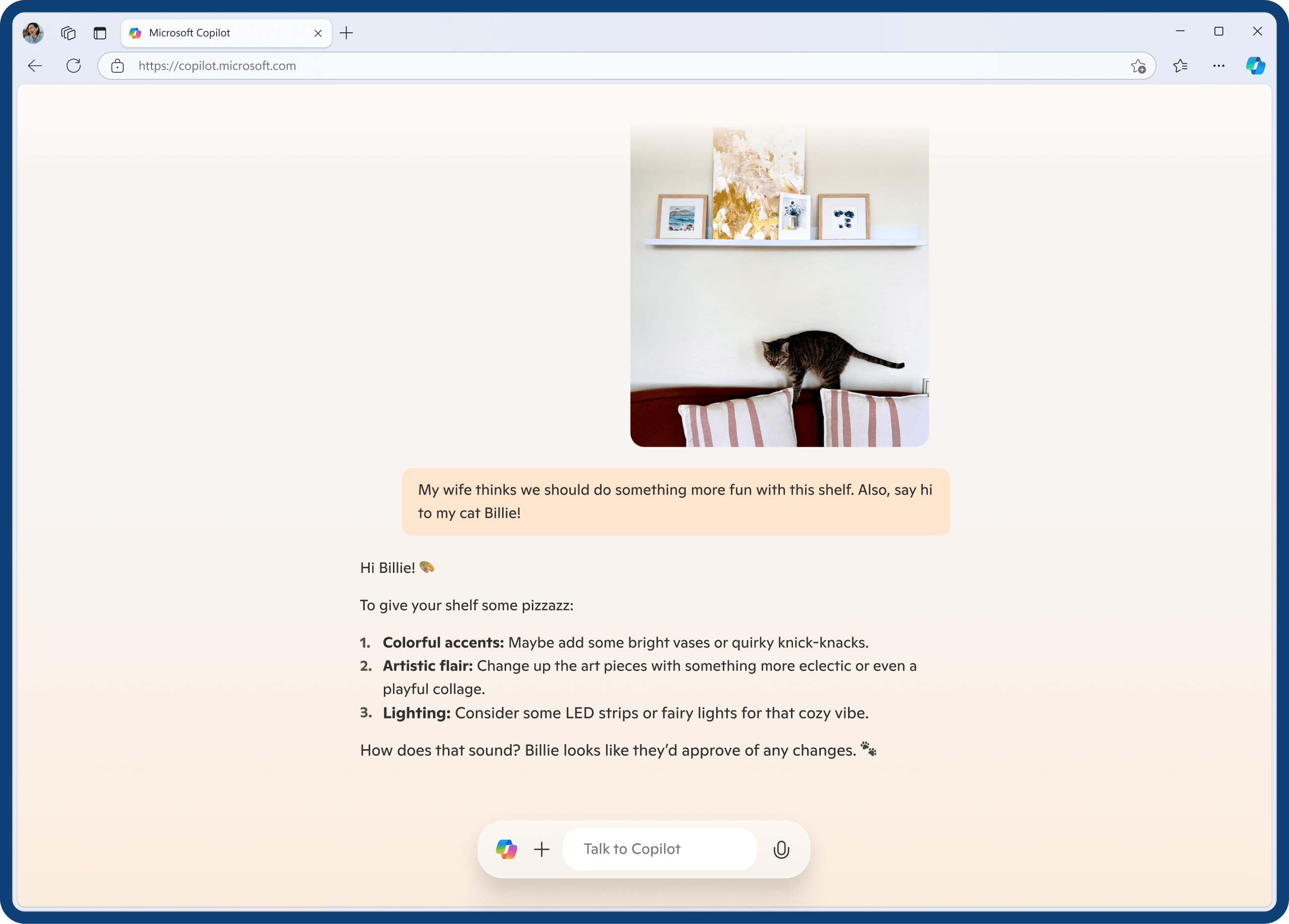

Візуальний пошук дозволяє завантажувати зображення в Copilot і задавати питання про них. Наприклад, ви можете поставити запитання про зображення, які важко описати, отримати рецепт страви, назви якої ви не знаєте, визначити породу собаки, яку ви не впізнаєте, і багато іншого. Щоб скористатися візуальним пошуком, натисніть на піктограму камери в рядку введення в Copilot, завантажте зображення зі свого пристрою або надайте посилання на веб-сайт і запитайте.

Щоб дізнатися більше про Copilot Pro, відвідайте сторінку Copilot Pro.

Розкажіть про Responsible AI

Розкажіть про Responsible AI

Copilot шукає відповідний контент в Інтернеті, а потім узагальнює знайдену інформацію, щоб отримати корисну відповідь. Він також посилається на свої джерела, тому ви можете бачити посилання на контент, на який він посилається.

У корпорації Майкрософт ми серйозно ставимося до своїх зобов'язань щодо відповідального штучного інтелекту. Copilot розроблено відповідно до наших принципів штучного інтелекту. Ми співпрацюємо з нашим партнером OpenAI, щоб забезпечити досвід, який заохочує відповідальне використання та роботу фундаментальної моделі. Ми розробили користувацький досвід Copilot, щоб тримати людей у центрі уваги, і розробили систему безпеки, призначену для пом'якшення збоїв і уникнення неправильного використання з такими речами, як фільтрація вмісту, оперативний моніторинг, виявлення зловживань та інші заходи безпеки. Відповідальний штучний інтелект – це подорож, і ми постійно вдосконалюємо наші системи на цьому шляху. Щоб дізнатися більше про відповідальне використання Copilot, перегляньте наші Умови використання та Кодекс поведінки.

Хоча Copilot працює над тим, щоб уникнути поширення несподіваного образливого контенту в результатах пошуку, і вжив заходів для запобігання взаємодії функцій Copilot з потенційно шкідливими темами, ви все одно можете побачити несподівані результати. Ми постійно вдосконалюємо наші технології, щоб запобігати шкідливому контенту.

Якщо ви зіткнулися зі шкідливим або неприйнятним вмістом, будь ласка, надайте відгук або повідомте про занепокоєння Copilot, натиснувши кнопку «Надати відгук» у налаштуваннях або використовуйте значок прапорця під кожною відповіддю на мобільному телефоні та веб-сторінці Copilot. У додатку Copilot ви можете довго натискати відповідь і вибирати «Повідомити». Ми й надалі працюватимемо з відгуками користувачів, щоб забезпечити безпечний пошук.

Copilot прагне відповідати надійними джерелами, але штучний інтелект може робити помилки, а сторонній контент в Інтернеті не завжди може бути точним або надійним. Copilot може спотворити знайдену інформацію, і ви можете побачити відповіді, які звучать переконливо, але є неповними, неточними або недоречними. Використовуйте своє судження та двічі перевіряйте факти, перш ніж приймати рішення або вживати заходів на основі відповідей Copilot. Перегляд цитат Copilot – гарне місце, щоб почати перевірку на точність.

Щоб поділитися відгуками на сайті або повідомити про проблему, виберіть кнопку «Надати відгук» у налаштуваннях або скористайтеся значком прапорця під кожною відповіддю на мобільному пристрої та веб-сторінці Copilot. У програмі Copilot ви також можете довго натискати відповідь і вибирати «Повідомити». Ми продовжуватимемо працювати з відгуками користувачів, щоб забезпечити безпечний пошук для всіх.

Докладніше про історію чатів

Докладніше про історію чатів

Так, якщо ви ввійшли в систему, розмови, які ви ведете з Copilot, зберігаються; Ми називаємо це "Історія чату". Ви можете переглядати та отримувати доступ до кожної розмови, яку ви раніше вели з Copilot. Наприклад, якщо ви попросите Copilot надати інформацію про першу людину, яка ступила на Місяць, ваша розмова збережеться в історії чату, до якої ви можете повернутися в будь-який час. За умовчанням ми зберігаємо дані історії чату протягом 18 місяців з моменту останнього оновлення бесіди. Ви можете отримати доступ до історії чату та видалити її, перейшовши на головну сторінку та вибравши піктограму машини часу.

У налаштуваннях Copilot доступні два налаштування для керування даними Copilot:

- Ви можете вимкнути здатність штучного інтелекту використовувати ваші дані для навчання моделей. Для цього перейдіть > Вхід Налаштування > Обліковий запис > Конфіденційність >Навчання моделі». Ви також можете перейти до розділу Конфіденційність > Експорт/Видалити, щоб видалити історію чату з account.microsoft.com. Зверніть увагу, що якщо ви перебуваєте в Європейській економічній зоні (ЄЕЗ), Великій Британії та деяких інших країнах, Copilot наразі не використовує ваші дані для навчання моделей.

- Персоналізацію можна вимкнути. Якщо ви використовуєте це налаштування, ви все одно матимете доступ до історії чату, і всі майбутні чати зберігаються, але досвід Copilot не є персоналізованим. Якщо ви вирішите ввімкнути цей досвід, Copilot також використовуватиме історію пошуку Bing і висловлену зацікавленість від MSN для створення більш персоналізованих, плавних розмов. Для користувачів у ЄЕЗ, Великій Британії та обмеженій кількості інших країн ми розглядаємо варіанти, перш ніж пропонувати цей рівень персоналізації для цих користувачів. Де це пропонується, Copilot повідомить користувачів і надасть їм зрозумілий і простий спосіб відмовитися від персоналізації.

Щоб видалити історію чату Copilot, у меню «Налаштування » перейдіть до розділу «Обліковий запис» > «Конфіденційність» > «Експорт» або «Видалити історію», щоб видалити історію з панелі конфіденційності Microsoft. Крім того, на панелі конфіденційності Microsoft натисніть «Перегляд і пошук» і прокрутіть униз до розділу «Історія пошуку». У полі пошуку знайдіть і видаліть усі інсталяції, які містять "Microsoft Copilot".

Якщо ви хочете видалити чати з Copilot до 01.10.2004 (застарілий досвід), на панелі конфіденційності Microsoft натисніть «Перегляд і пошук», прокрутіть униз до розділу «Історія активності Copilot» і натисніть «Очистити всю історію активності Copilot та історію пошуку».

Так, ми зберігаємо деяку історію ваших чатів, включно з підказками, щоб надавати та покращувати сервіс. Ваші підказки підтримуються відповідно до нашої Заяви про конфіденційність і використовуються для моніторингу продуктивності, усунення неполадок, діагностики помилок, запобігання зловживанням та іншої аналітики продуктивності продукту, необхідної для забезпечення та вдосконалення Copilot. Для персоналізованих відповідей використовуються лише дані, видимі в історії чату в продукті.

Щоб дізнатися більше про методи забезпечення конфіденційності Microsoft, перегляньте Декларацію корпорації Майкрософт про конфіденційність і наш Центр конфіденційності.

Персоналізуйте свій досвід Copilot

Персоналізуйте свій досвід Copilot

Якщо ви ввімкнете персоналізацію, ми використовуватимемо ваші останні розмови та дії Microsoft для персоналізації вашої роботи. Залежно від настройок конфіденційності ваші дії в Microsoft можуть, зокрема, включати дії в пошуку Bing, дії MSN і передбачувані інтереси. Якщо ви не хочете, щоб ми персоналізували певну бесіду з вашої історії чату, журналу пошуку або припущених інтересів, ви можете видалити їх на панелі конфіденційності Microsoft. Персоналізацію можна вимкнути в будь-який час, натиснувши піктограму облікового запису у верхньому правому куті сторінки, > обліковий запис > конфіденційність > персоналізацію. На Edge ви можете вимкнути, натиснувши «...»: у меню налаштувань Copilot > дозволів та конфіденційності > персоналізації.

Дозвіл персоналізації Copilot означає, що ви дозволяєте корпорації Майкрософт використовувати ваші нещодавні розмови та дії Microsoft, включно з пошуком Bing і діями MSN, щоб зробити Copilot більш персоналізованим для вас. Copilot пам'ятає вашу історію та може робити висновки з цієї історії про ваші інтереси, хобі тощо, щоб надати персоналізований досвід. Однак, як користувач Copilot, ви можете видалити всі повідомлення чату.

Ні. Перемикач персоналізації Copilot (доступний на всіх поверхнях Copilot) контролює, чи використовуються останні розмови та ваші дії Microsoft для персоналізації. Перемикач персоналізації та реклами Edge визначає, чи можна використовувати дії перегляду Edge на різних поверхнях Microsoft для персоналізації, включаючи Copilot.

Ви самі вирішуєте, які чати використовуються для персоналізації вашого досвіду. Якщо ви не хочете, щоб Copilot персоналізував використання вашої історії чату, ви можете очистити історію активності Copilot на панелі конфіденційності Microsoft. Після видалення чати не використовуватимуться для персоналізації взаємодії.

Персоналізацію ввімкнено за умовчанням, за винятком тих, що діють у Європейській економічній зоні (ЄЕЗ), Великій Британії та деяких інших країнах. Користувачі мають можливість відмовитися від цього досвіду. У своїх бесідах ви отримуватимете сповіщення про те, чи є ваш досвід персоналізованим чи ні. Ми відобразимо повідомлення на кшталт «Copilot може дізнатися про ваші інтереси та персоналізувати ваш досвід», якщо персоналізований досвід дозволено. Повідомлення на кшталт «Розмови використовуються для навчання штучного інтелекту, а Copilot може дізнатися про ваші інтереси» відображатиметься, коли дозволено як навчання, так і персоналізацію. Залежно від вашого регіону персоналізація може бути доступна за замовчуванням. Персоналізація недоступна для користувачів, які не пройшли автентифікацію.

Ми дотримуємося наших практик відповідального штучного інтелекту та повільно впроваджуємо цю функцію; Тому ця функція може бути недоступною в Європейській економічній зоні (ЄЕЗ), Великій Британії та деяких інших країнах.

Ви можете вимкнути персоналізацію за допомогою налаштувань персоналізації в меню налаштувань Copilot.

Якщо ви зміните свою згоду на персоналізацію з «так» на «ні», ми припинимо надавати персоналізований досвід Copilot. Ми збережемо вашу історію чату, щоб ви могли переглядати свої минулі розмови. Однак ваш майбутній досвід Copilot більше не буде персоналізованим.

Так, ви можете в будь-який час вимкнути персоналізацію в налаштуваннях Copilot. Якщо вимкнути персоналізацію, історія бесід не буде видалена.

Незалежно від ваших налаштувань користувача, Copilot розроблено не для персоналізації взаємодії на основі деяких тем, щоб захистити вашу конфіденційність і запобігти використанню потенційно конфіденційної інформації. Наприклад, ми вживаємо заходів, щоб виключити з ваших попередніх бесід контекст, який може вважатися конфіденційним, навіть якщо у ваших налаштуваннях увімкнено історію та персоналізацію чату. Користувачі повинні бути обережними, ділячись інформацією, яку вони вважають конфіденційною, з Copilot.

Перегляд параметрів використання даних і керування

Перегляд параметрів використання даних і керування

Генеративний ШІ відноситься до категорії моделей штучного інтелекту, які аналізують дані, знаходять закономірності та використовують ці шаблони для створення або створення нового результату, такого як текст, фото, відео, код, дані тощо. «Навчання» моделі штучного інтелекту означає надання їй даних, які допоможуть їй навчитися робити прогнози чи рішення. Навчання – це широке поняття, яке включає в себе безліч різних видів діяльності, які допомагають моделям вивчати попереднє навчання генеративної моделі штучного інтелекту, тонке налаштування моделі або навчання класифікатора чи фільтра, щоб допомогти моделям отримувати більш відповідні результати.

Ці моделі використовують закономірності та кореляції, отримані з їхніх тренувальних даних, щоб передбачити, що буде далі в послідовності. Вони налаштовані на вивчення загальних відносин в мові, а не на запам'ятовування конкретних відрізків тренувальних даних. Вони не зберігають і не мають доступу до оригінальних тренувальних даних. Натомість генеративні моделі штучного інтелекту призначені для створення нових виразних робіт і контенту. Ми також вживаємо додаткових заходів, щоб запобігти ненавмисному відтворенню тренувальних даних цих моделей, наприклад проводимо тестування та створюємо фільтри, які відсівають раніше опублікований або використаний матеріал.

Корпорація Майкрософт використовує загальнодоступні дані, зібрані переважно зі стандартних галузевих наборів даних машинного навчання та веб-сканувань, як-от пошукових систем. Ми виключаємо джерела з платним доступом, контент, який порушує наші правила, або сайти, які відмовилися від навчання за допомогою опублікованих нами веб-елементів керування. Крім того, ми не тренуємося на даних із доменів, перелічених у списку сумнозвісних ринків для підробок і піратства Управління торгового представника США (USTR).

Ми не тренуємося на даних наших комерційних клієнтів або будь-яких даних користувачів, які увійшли в обліковий запис організації M365/EntraID. Крім того, ми не проводимо навчання на даних з особистих або сімейних передплат M365 або на даних користувачів, які не ввійшли у свій обліковий запис Microsoft.

Microsoft почне використовувати дані споживачів для навчання ШІ в певних країнах пізніше цього року. Для користувачів, які увійшли в обліковий запис Microsoft, ви зможете контролювати, чи використовуються ваші дані споживачів для навчання генеративних моделей штучного інтелекту, які використовуються в Copilot та інших пропозиціях штучного інтелекту від Microsoft, за допомогою контролю відмови. Відмова виключить використання ваших минулих, поточних і майбутніх даних споживачів для навчання цих моделей штучного інтелекту, якщо ви не вирішите приєднатися знову. Протягом наступних місяців цей параметр стане доступним у веб-версіях, версіях для настільних комп'ютерів і мобільних пристроях усіх споживчих продуктів. Ви також бачитимете повідомлення в продукті, які сповіщають вас про новий елемент керування користувачами, зокрема в Bing, MSN і Copilot.

Ми обмежимо дані, які використовуємо для навчання. Ми не проводитимемо навчання на даних наших клієнтів із державного сектору або корпоративних компаній, якщо вони прямо не подадуть на це згоду, а також не проводитимемо навчання на даних із пропозицій для споживачів M365. Дізнайтеся більше тут. Крім того, ми не навчатимемо моделі штучного інтелекту на даних особистих облікових записів, таких як дані профілю облікового запису Microsoft або вміст електронної пошти. Якщо у ваші розмови зі штучним інтелектом з'являються будь-які зображення, ми вживаємо заходів для їх знеособлення, наприклад видаляємо метадані або інші особисті дані та розмиваємо зображення облич.

Ваша особиста взаємодія з нашими сервісами, як-от запити та відповіді, залишається конфіденційною та не розголошується без вашого дозволу. Ви можете налаштувати персоналізацію в налаштуваннях.

Ми видаляємо інформацію, яка може вас ідентифікувати, як-от імена, номери телефонів, ідентифікатори пристроїв або облікових записів, конфіденційні особисті дані, фізичні адреси та адреси електронної пошти, перед навчанням моделей штучного інтелекту.

Ваші дані залишаються конфіденційними під час використання наших послуг. Ми й надалі оцінюватимемо наші моделі та вживатимемо заходів, щоб запобігти відтворенню ними інформації про користувачів або попередніх розмов. Ми захищатимемо ваші особисті дані, як описано в Декларації корпорації Майкрософт про конфіденційність, і відповідно до законів про конфіденційність у всьому світі.

Ми не використовуємо дані користувачів віком до 18 років. Ми навчаємо наші генеративні моделі штучного інтелекту лише на даних від автентифікованих користувачів MSA віком від 18 років. Крім того, якщо ви перебуваєте в Європейській економічній зоні (ЄЕЗ), Великій Британії та деяких інших країнах, перелічених нижче, ваші дані наразі не використовуються для навчання моделей штучного інтелекту.

Microsoft почне використовувати дані з Bing, MSN, Copilot і взаємодію з рекламою на Microsoft для навчання ШІ пізніше цього року. Це включає анонімні дані пошуку та новин, взаємодію з рекламою, а також дані голосових і текстових розмов із Copilot, як-от підказки, запити, чати, відповіді та інші. Ці дані будуть використані для вдосконалення Copilot та інших наших генеративних моделей штучного інтелекту, щоб створити кращий користувацький досвід для вас та інших. Ці генеративні моделі штучного інтелекту також можуть використовуватися для покращення інших продуктів і служб Microsoft. Користувачі, які увійшли до свого облікового запису Microsoft, можуть контролювати, чи використовуються ваші дані споживачів для навчання генеративних моделей штучного інтелекту, які використовуються в Copilot та інших пропозиціях штучного інтелекту від Microsoft, за допомогою контролю відмови.

Використовуючи реальні дані споживачів для навчання наших базових генеративних моделей штучного інтелекту, ми можемо вдосконалити Copilot у майбутньому та запропонувати більш персоналізований та актуальний досвід природної мови. Наприклад, наші моделі штучного інтелекту можуть використовувати ці розмови, щоб вчитися на людських моделях спілкування, таких як розуміння розмовних фраз або місцевих посилань. Чим більшій різноманітності в розмовах піддаються наші моделі штучного інтелекту, тим краще вони розумітимуть і обслуговуватимуть важливі регіональні мови, географії, культурні посилання та актуальні теми, що цікавлять користувачів.

Ми також використовуємо розмови Copilot та інші дані споживачів для цифрової безпеки, захисту та відповідності, як описано в Декларації про конфіденційність Microsoft.

Перш ніж ми почнемо навчання, ми також спростимо для людей можливість за бажанням відмовитися від використання даних, якими вони діляться в цих службах, для навчання наших генеративних моделей штучного інтелекту. Починаючи з жовтня, ми запровадимо засоби контролю за відмовою. Щоб дати користувачам достатньо часу для обмірковування свого вибору, ми також не почнемо навчати моделі штучного інтелекту на цих даних принаймні через 15 днів після надання цих елементів керування. Наразі ми не використовуватимемо дані споживачів для навчання моделей у Європейській економічній зоні (ЄЕЗ), Великій Британії та деяких інших країнах, перелічених нижче. Ми поступово впроваджуватимемо цю функцію в цих регіонах, щоб гарантувати, що ми отримуємо це право для споживачів і дотримуємося місцевих законів про конфіденційність у всьому світі.

Ця настройка відмови не виключає використання ваших даних для інших загальних удосконалень продуктів або систем, а також для реклами, цифрової безпеки, захисту та відповідності вимогам, як описано в декларації корпорації Майкрософт про конфіденційність.

Споживачам, яким виповнилося 18 років і які увійшли у свої облікові записи Microsoft (споживчі), буде запропонована можливість відмовитися від навчання зі штучним інтелектом, починаючи з жовтня. У вересні це налаштування буде недоступне на таких ринках: Австрія, Бельгія, Бразилія, Болгарія, Канада, Китай (включно з Гонконгом), Хорватія, Кіпр, Чеська Республіка, Данія, Естонія, Фінляндія, Франція, Німеччина, Греція, Угорщина, Ісландія, Ірландія, Ізраїль, Італія, Латвія, Ліхтенштейн, Литва, Люксембург, Мальта, Нідерланди, Норвегія, Нігерія, Польща, Португалія, Румунія, Словаччина, Словенія, Південна Корея, Іспанія, Швеція, Швейцарія, Велика Британія та В'єтнам. Сюди входять регіони Гваделупа, Французька Гвіана, Мартініка, Майотта, острів Реюньйон, Сен-Мартен, Азорські острови, Мадейра та Канарські острови. Це означає, що пропозиції штучного інтелекту будуть доступні на цих ринках, але жодні дані користувачів не використовуватимуться для навчання генеративних моделей штучного інтелекту в цих місцях до подальшого повідомлення.

Ні, ніщо з того, що ви скажете Copilot, ніколи не буде оприлюднено. Copilot не матиме прямого доступу до вашої історії чату або особистих даних під час розмов з іншими користувачами.

Ця зміна стосується пропозицій Copilot для споживачів, включаючи Copilot Pro.

Це виключає користувачів Copilot із комерційним захистом даних і будь-яких користувачів Microsoft 365 або розмов Copilot, інтегрованих у споживчі програми Microsoft 365, такі як Word, Excel, PowerPoint або Outlook. Користувачі цих продуктів не бачитимуть цього налаштування, а їхні розмови не використовуватимуться для навчання генеративних моделей штучного інтелекту, які ми пропонуємо в Copilot або інших продуктах.

Ми усвідомлюємо, що комерційні клієнти мають різні вимоги до дотримання вимог у різних галузях і в усьому світі. Корпорація Майкрософт і надалі допомагатиме цим організаціям використовувати межі клієнтів та інші надані нами елементи керування, щоб окремо визначати дані, якими вони володіють, і керувати ними.

Так, деякі розмови Copilot підлягають як автоматизованій, так і людській перевірці як для вдосконалення продукту, так і з метою цифрової безпеки. Наприклад, щоб створювати, навчати та підвищувати точність наших автоматизованих методів обробки (включно зі штучним інтелектом або штучним інтелектом), ми вручну перевіряємо деякі результати, отримані автоматизованими методами, порівняно з базовими даними. Ми включаємо відгуки людей від тренерів і співробітників зі штучного інтелекту в наш навчальний процес. Наприклад, людський зворотний зв'язок, який підсилює якісний вихід на підказку користувача, покращуючи взаємодію з кінцевим користувачем.

Ми також можемо розглядати розмови, позначені як порушення Кодексу поведінки в Умовах. Наш Кодекс поведінки забороняє використання послуги Copilot для створення або обміну неприйнятним контентом або матеріалом. Деякі бесіди переглядаються при підозрі на порушення Кодексу поведінки.

Обмежений огляд на людях необхідний як частина процесу розслідування, коли є підозра на порушення Кодексу поведінки. Щоб гарантувати безпеку наших послуг для всіх, повна відмова від перевірки людиною недоступна.

Так, ви можете відмовитися від навчання зі штучним інтелектом і все одно ввімкнути персоналізацію. У цьому випадку Copilot запам'ятає останні розмови, щоб надати вам більш персоналізовану відповідь, але Microsoft не використовуватиме ваші розмови та інші дії Microsoft для навчання моделі генеративного ШІ. Наприклад, Copilot пам'ятатиме, що ви вегетаріанець, пропонуючи рецепти вечері.

Ми не будемо передавати ваші дані третім сторонам або партнерам для навчальних цілей зі штучним інтелектом без вашого дозволу.

Ваші розмови з Copilot, як-от запити та відповіді, не розголошуються та не продаються третім сторонам, за винятком таких обмежених випадків:

Корпорація Майкрософт надає доступ до деяких особистих даних третім особам відповідно до нашої Декларації про конфіденційність Microsoft. Наприклад, корпорація Майкрософт може надавати доступ до ваших особистих даних афілійованим і дочірнім компаніям, які контролюються корпорацією Майкрософт, постачальникам, які працюють від нашого імені, а також у випадках, коли це вимагається законом або для виконання вимог судового процесу.

Щоб підвищити безпеку Copilot і здатність виявляти ризики, команда Copilot співпрацює із зовнішніми дослідницькими організаціями для перегляду та оцінки журналів Copilot. Наприклад, зовнішні дослідницькі організації можуть допомогти переглянути журнали розмов Copilot, щоб зрозуміти різноманітність запитів, які використовуються для пошуку екстремістського контенту, порівняти тенденції в галузі та порадити методи для кращого пошуку та пом'якшення шкоди.

- * Доступність і можливості функцій можуть відрізнятися залежно від типу пристрою, ринку та версії браузера.

- * Можливо, вміст цієї сторінки перекладено за допомогою штучного інтелекту.